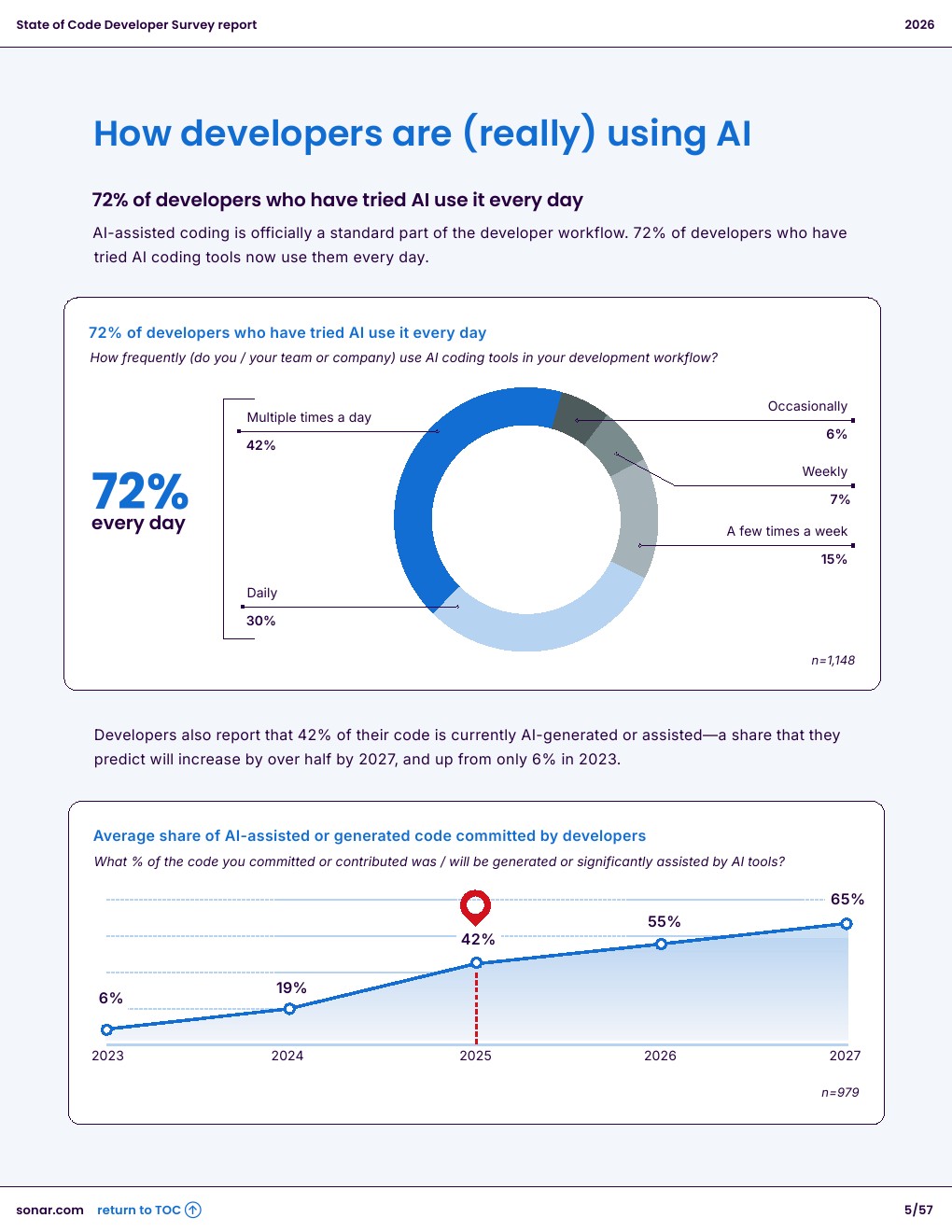

本报告基于对1149名开发者的调研显示,AI编码工具已成为主流生产力工具,72%的开发者实现每日使用,AI生成或辅助代码占比已达42%,较2023年的6%大幅跃升,并预计到2027年仍将继续增长。

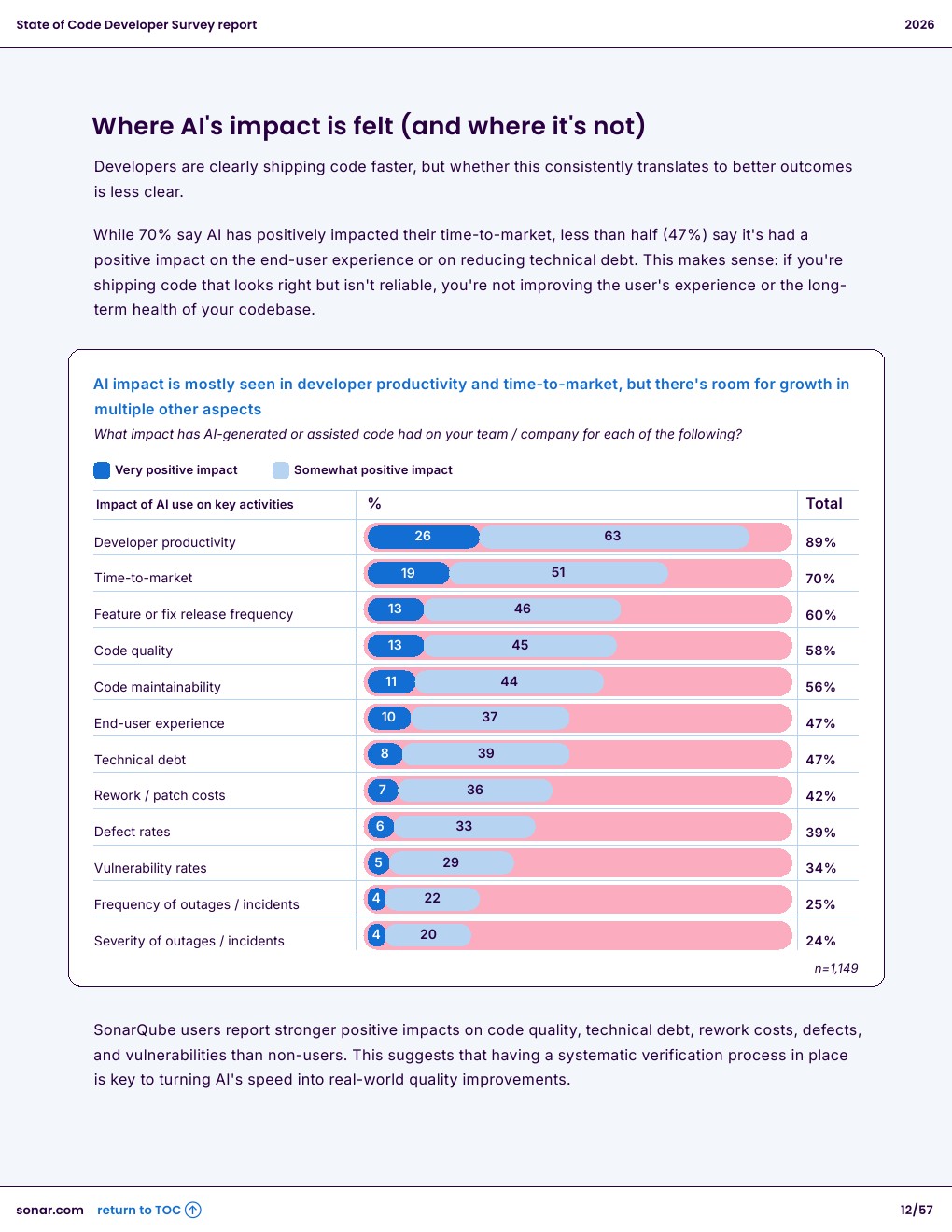

然而,生产力提升并未线性转化为效率红利,开发者平均仅感知35%的效率提升,同时验证成本显著上升,成为新的效率瓶颈。

从使用场景看,AI已渗透至完整开发生命周期,88%用于原型开发,73%进入面向客户应用,58%甚至进入关键业务系统。

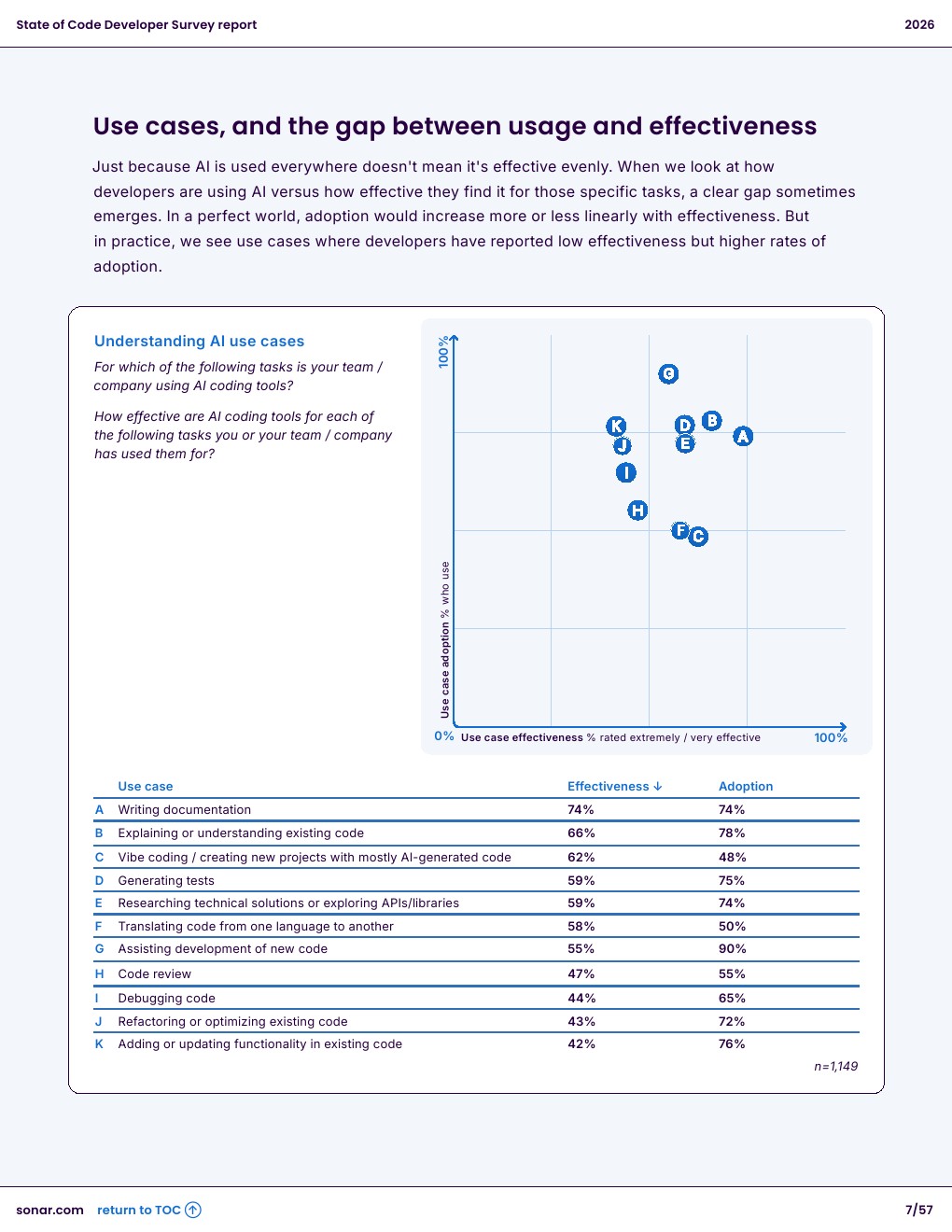

但使用与效果之间存在明显错配,90%的开发者使用AI生成新代码,但仅55%认为其高效,代码重构与优化场景有效性更低至43%。

AI在文档生成(74%)、代码解释(66%)等低复杂度任务中表现更优,显示其更像“解释器”而非“工程师” 。

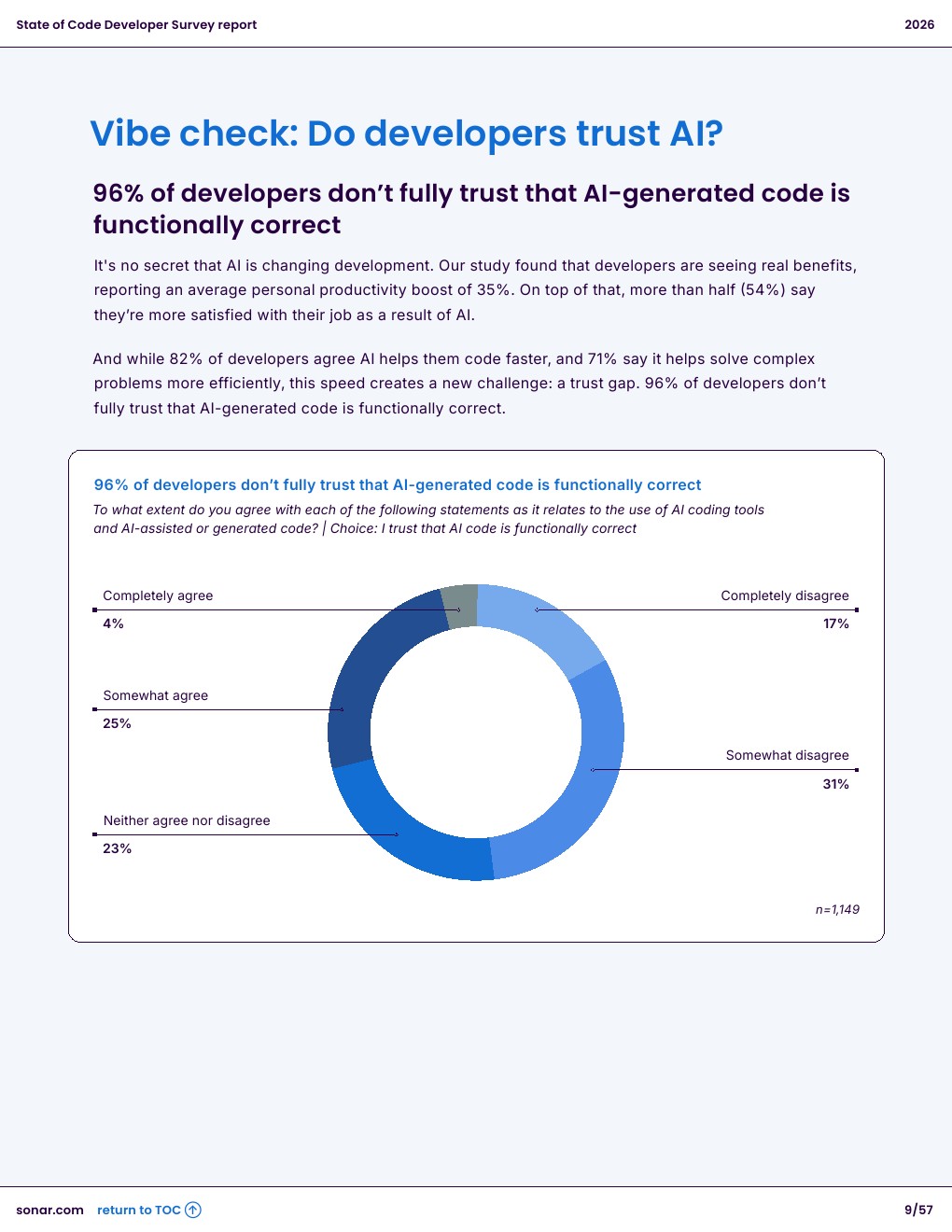

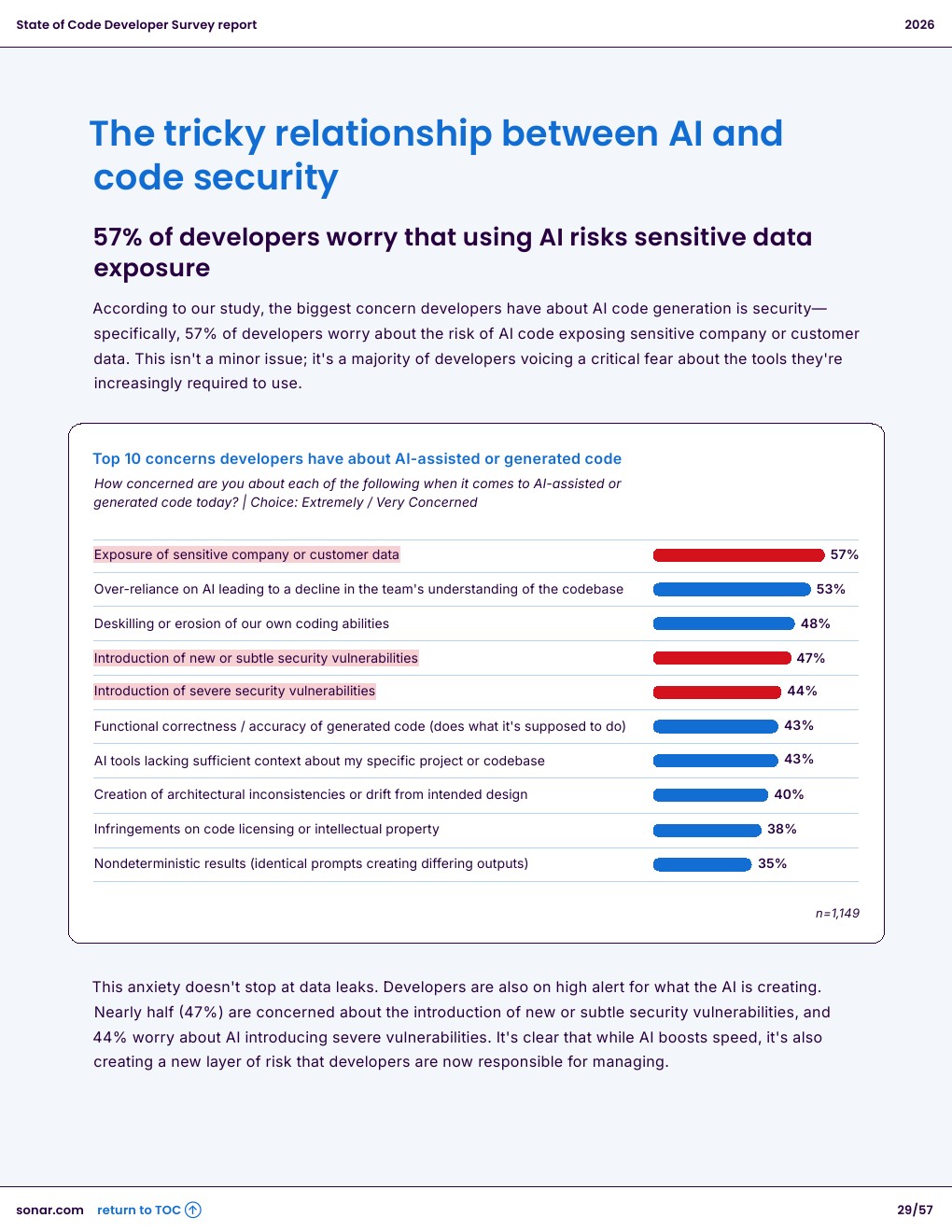

信任问题成为核心矛盾,96%的开发者不完全信任AI代码的正确性,95%需额外投入时间进行审查,其中59%认为审查成本较高 。

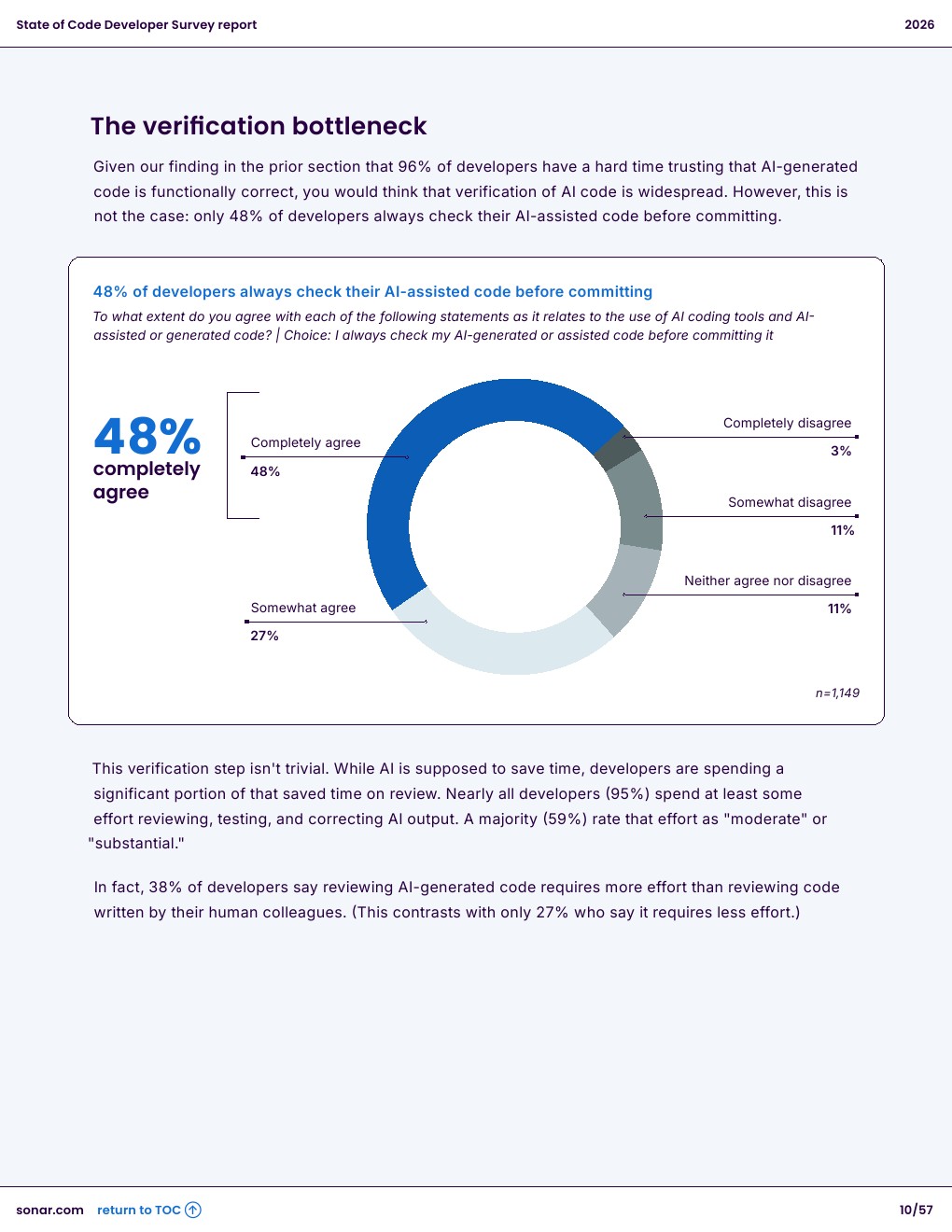

更值得关注的是,仅48%的开发者在提交前始终检查AI代码,暴露出流程与治理缺口。

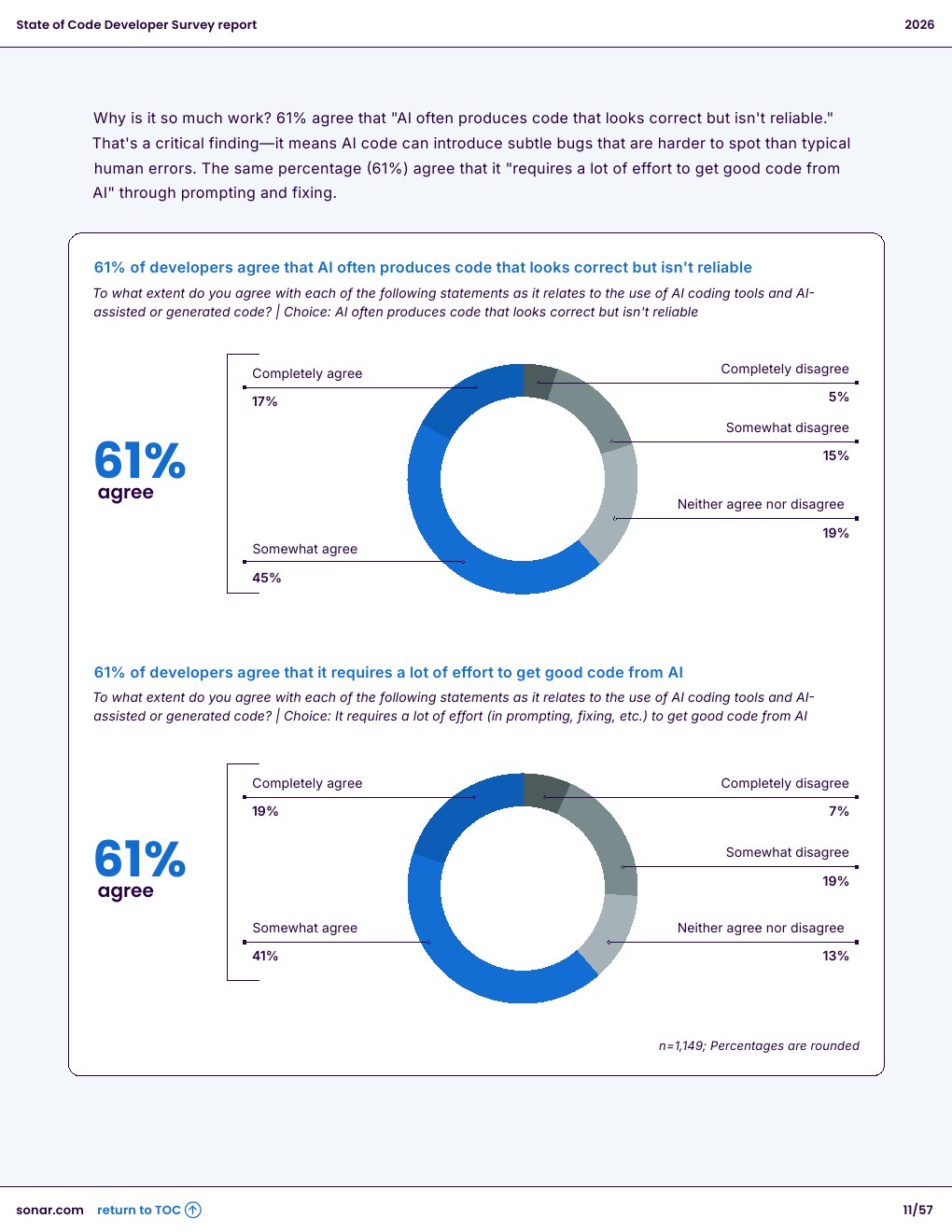

61%的开发者指出AI代码“看似正确但不可靠”,这一隐性缺陷加剧了技术债积累风险。

技术债呈现双向效应,88%的开发者认为AI带来负面影响,其中53%源于不可靠代码,40%来自冗余代码。

与此同时,93%的开发者也认可其正向价值,57%改善文档,53%提升测试覆盖率。

这表明AI既是“清道夫”,也是“污染源”,关键取决于治理能力。

在组织层面,小型企业更强调速度,生产力提升达39%,76%改善上市时间,但面临更高的返工与技术债压力。

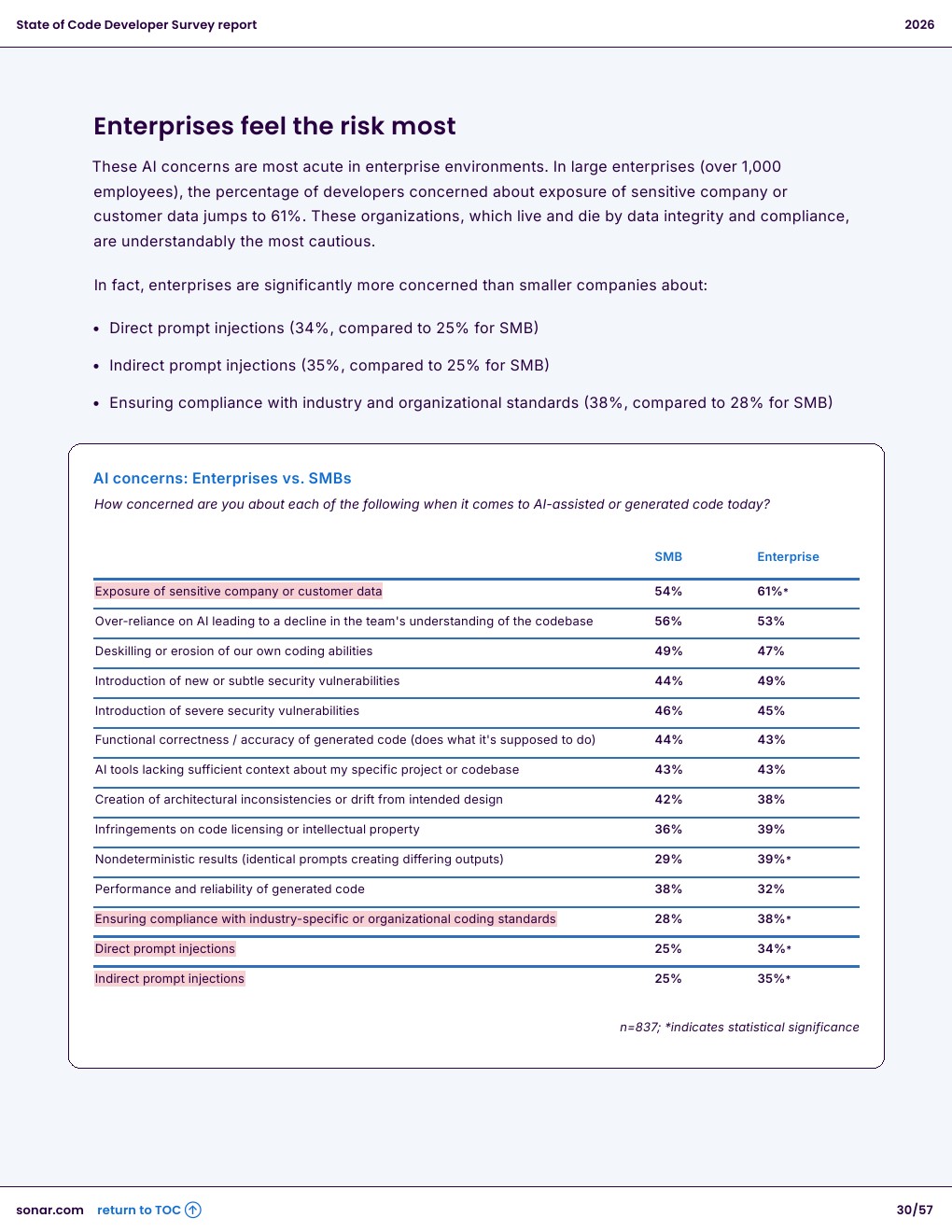

大型企业则更注重质量与合规,代码质量与可维护性提升更显著,同时61%对数据安全高度敏感,并加强治理机制。

这种分化体现出“速度与质量”的典型权衡。

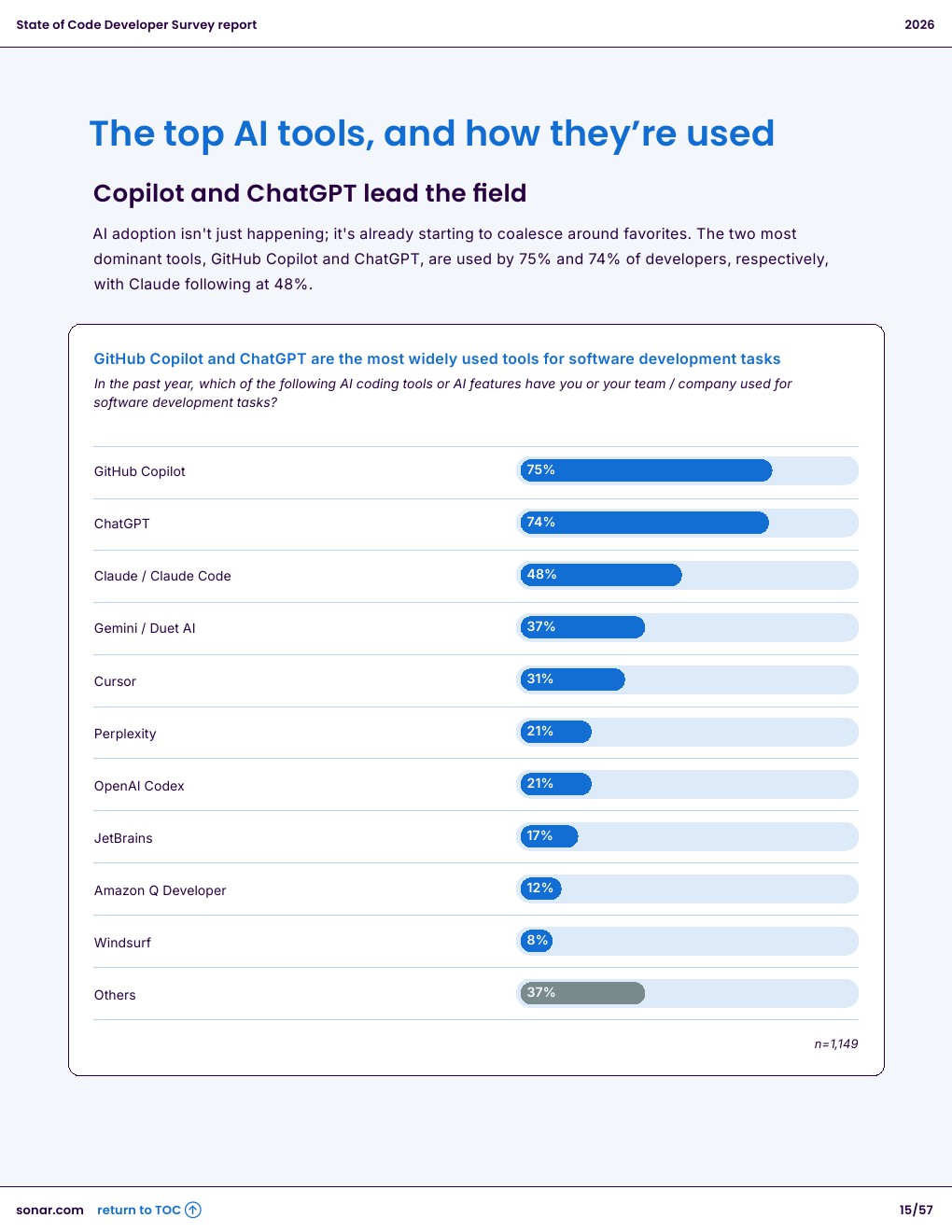

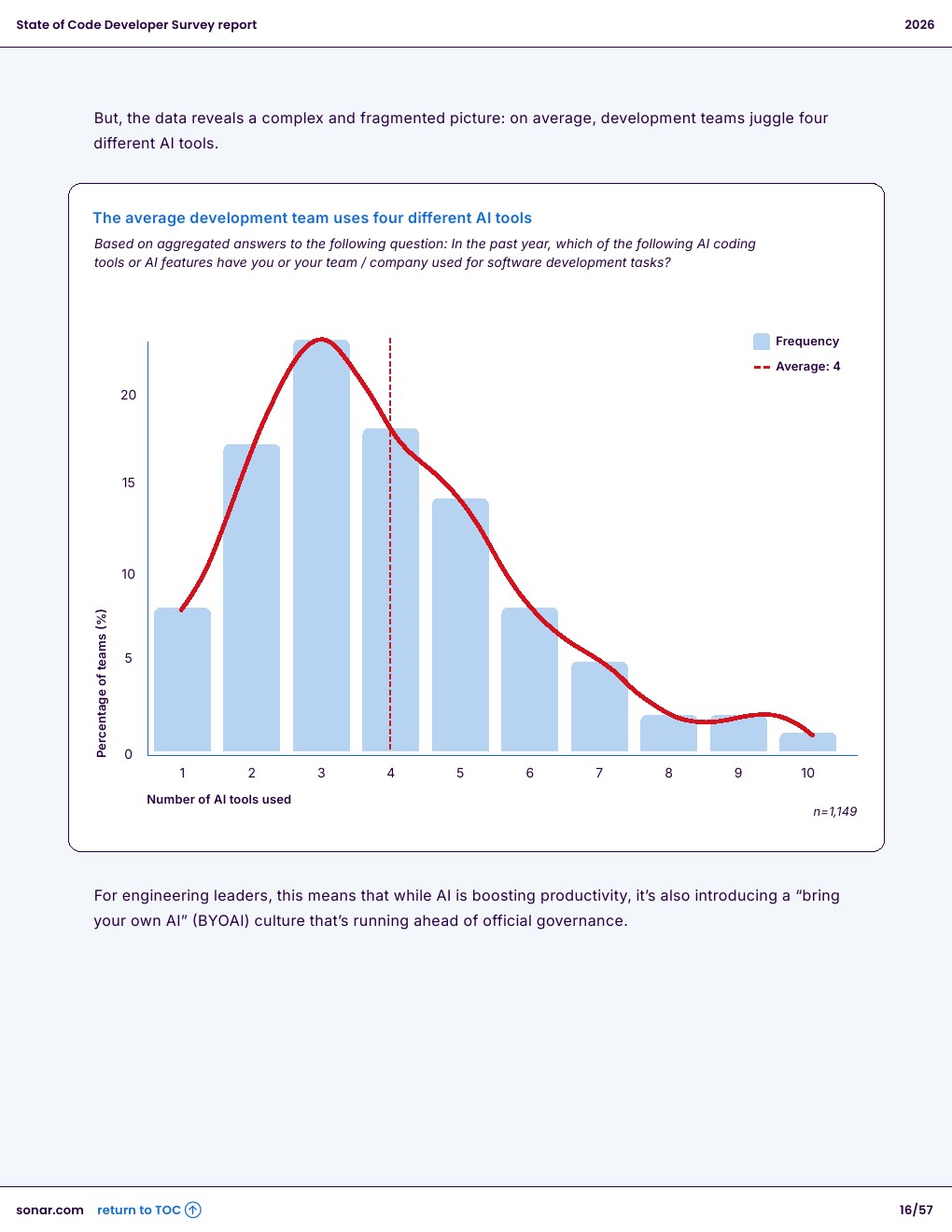

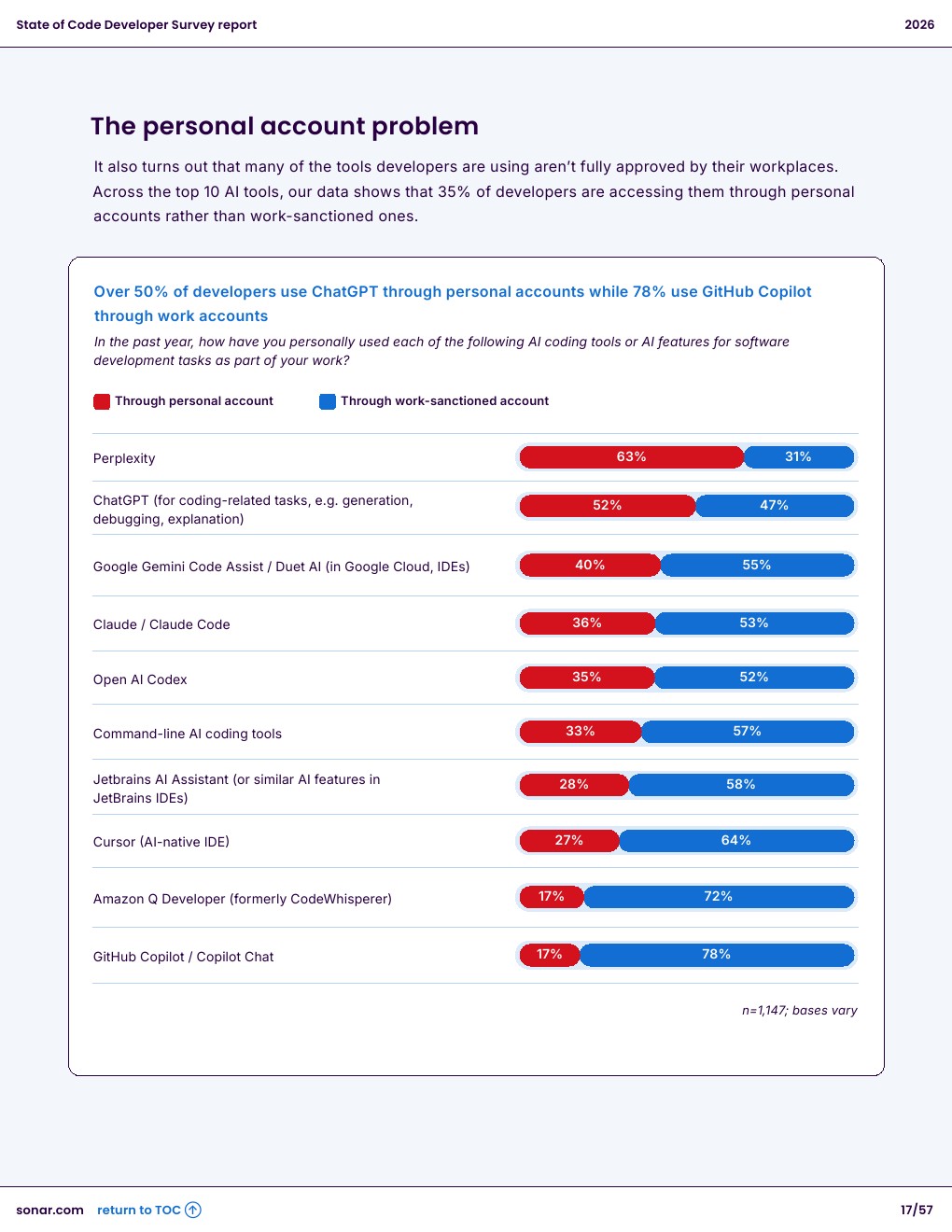

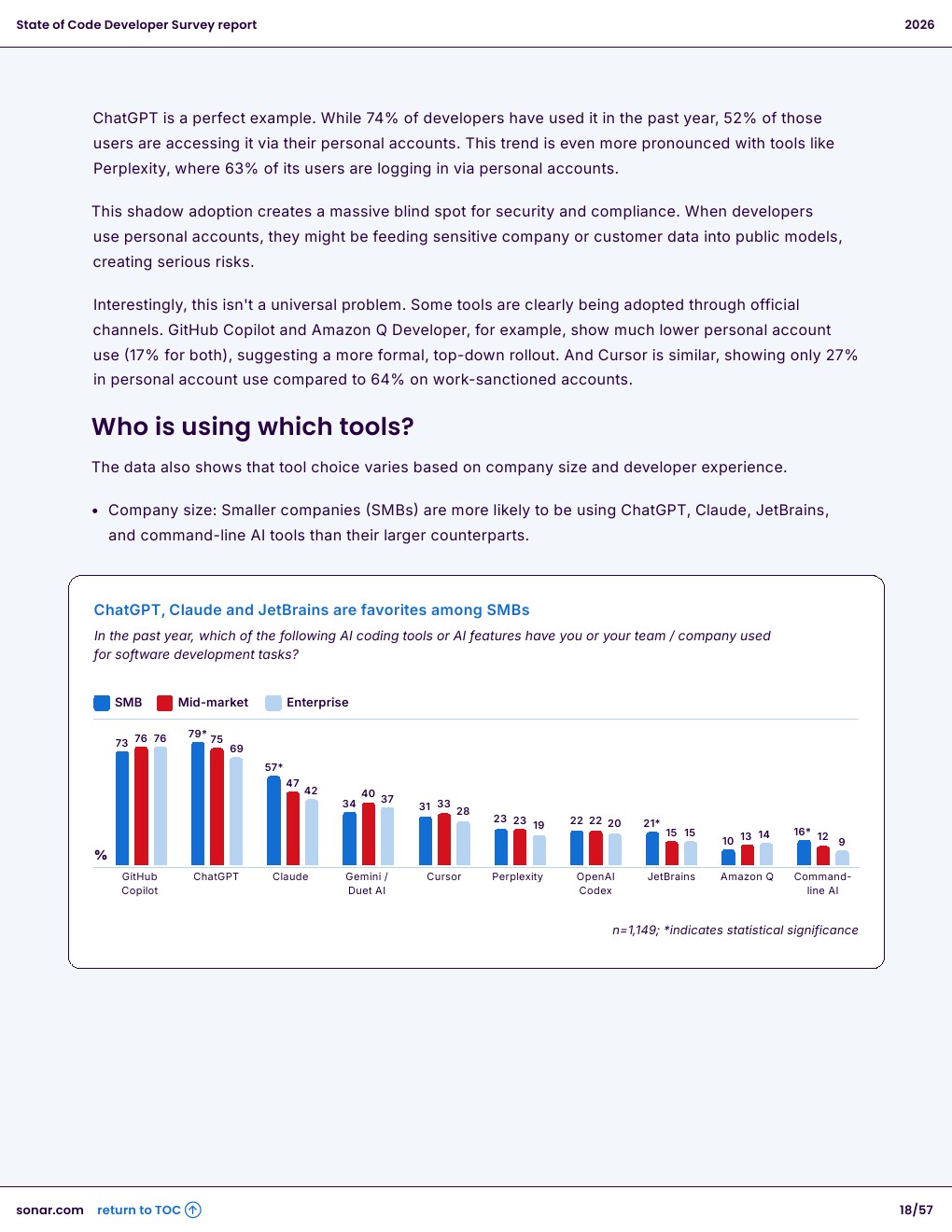

AI工具生态呈现碎片化趋势,团队平均使用4种工具,GitHub Copilot与ChatGPT渗透率分别达75%与74%。

但35%的开发者通过个人账户使用工具,带来数据泄露与合规风险。

“自带AI”模式正在挑战企业治理边界

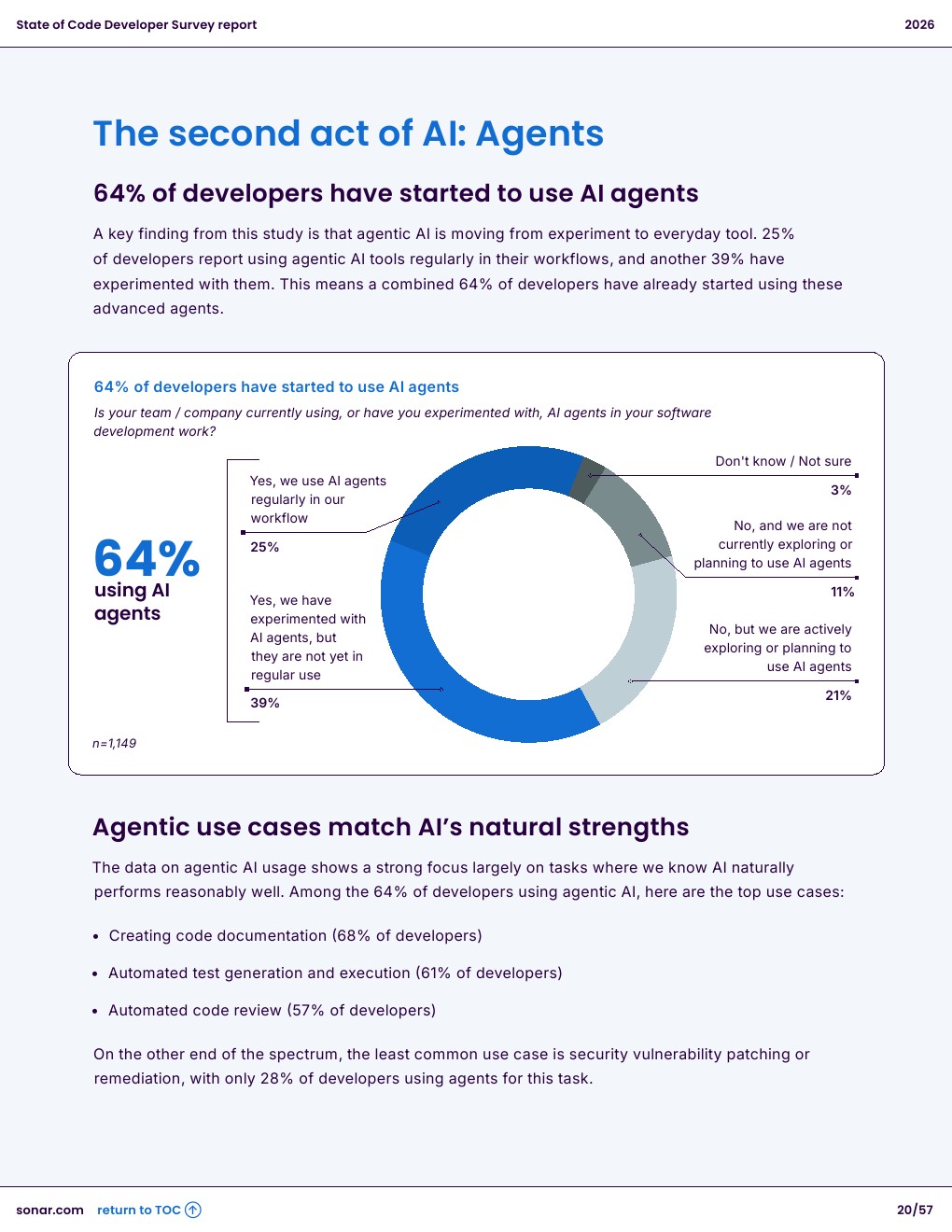

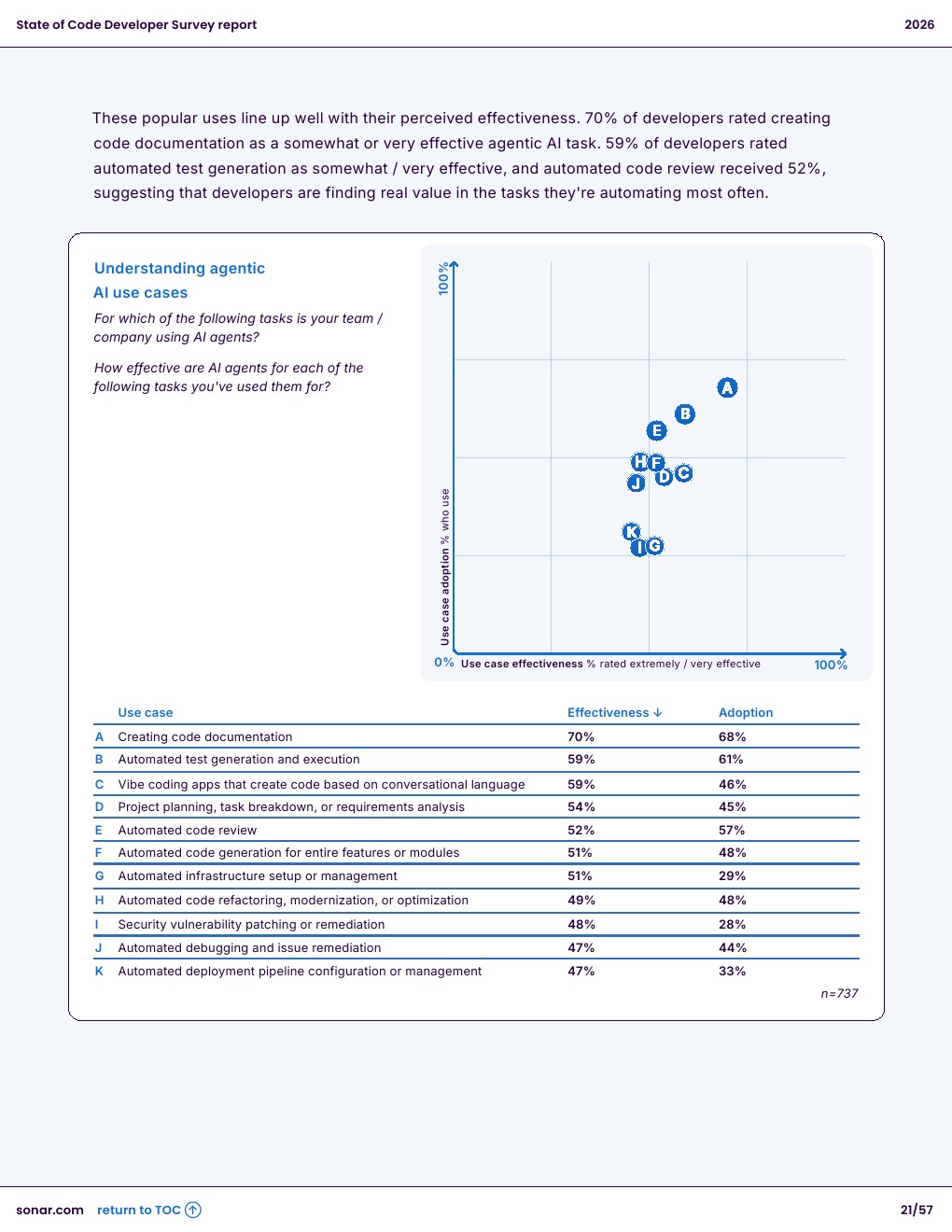

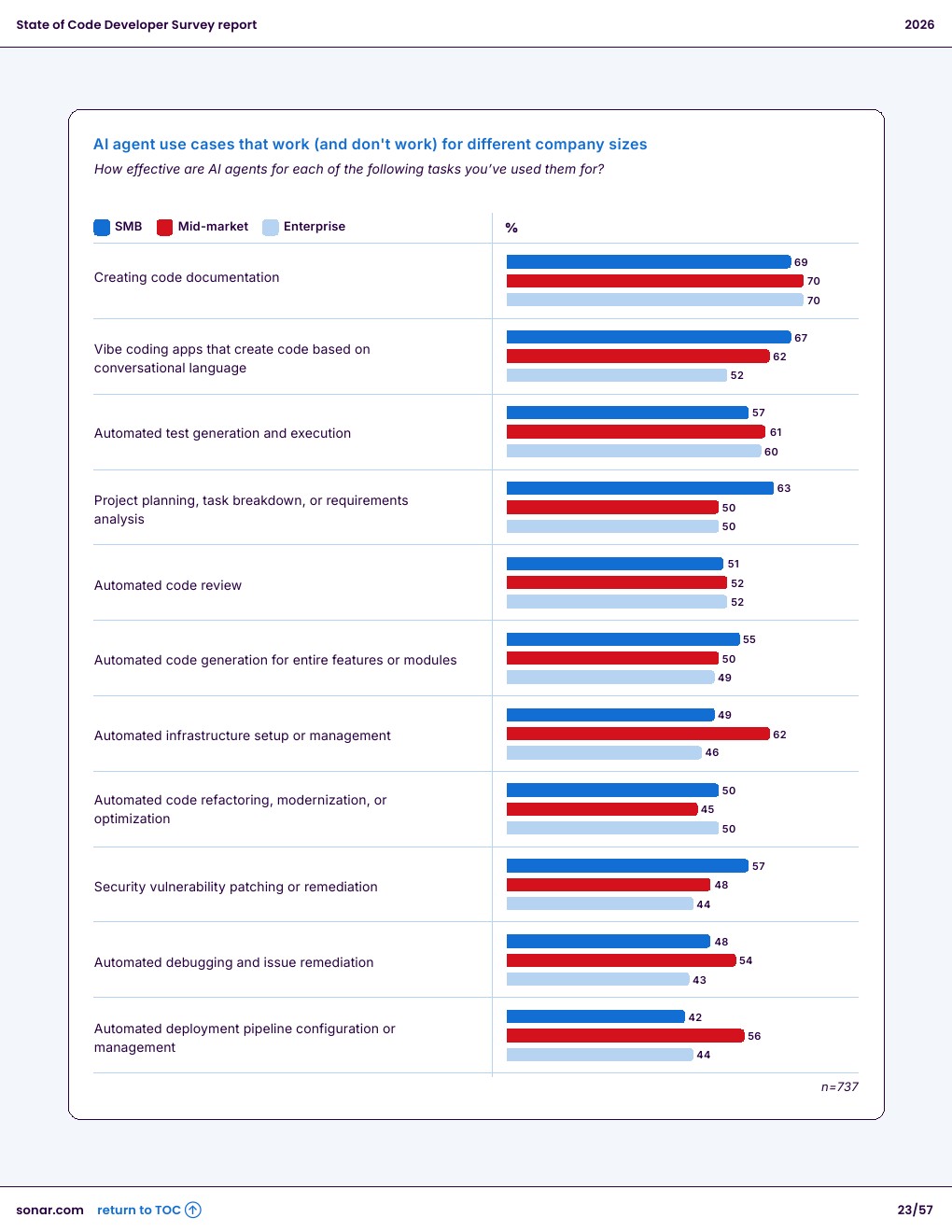

进一步演进中,64%的开发者已接触AI Agent,25%进入常态化使用,主要应用于文档生成、测试与代码审查。

但在安全修复等高风险领域应用仍不足,仅28%,反映信任与能力仍未匹配。

从人力结构看,经验差异显著影响AI收益,初级开发者生产力提升达40%,高于资深开发者的32%,但同时承担更高审查成本。

资深开发者更倾向将AI用于辅助与原型,而非核心代码生产,体现出更强的风险意识与使用策略。

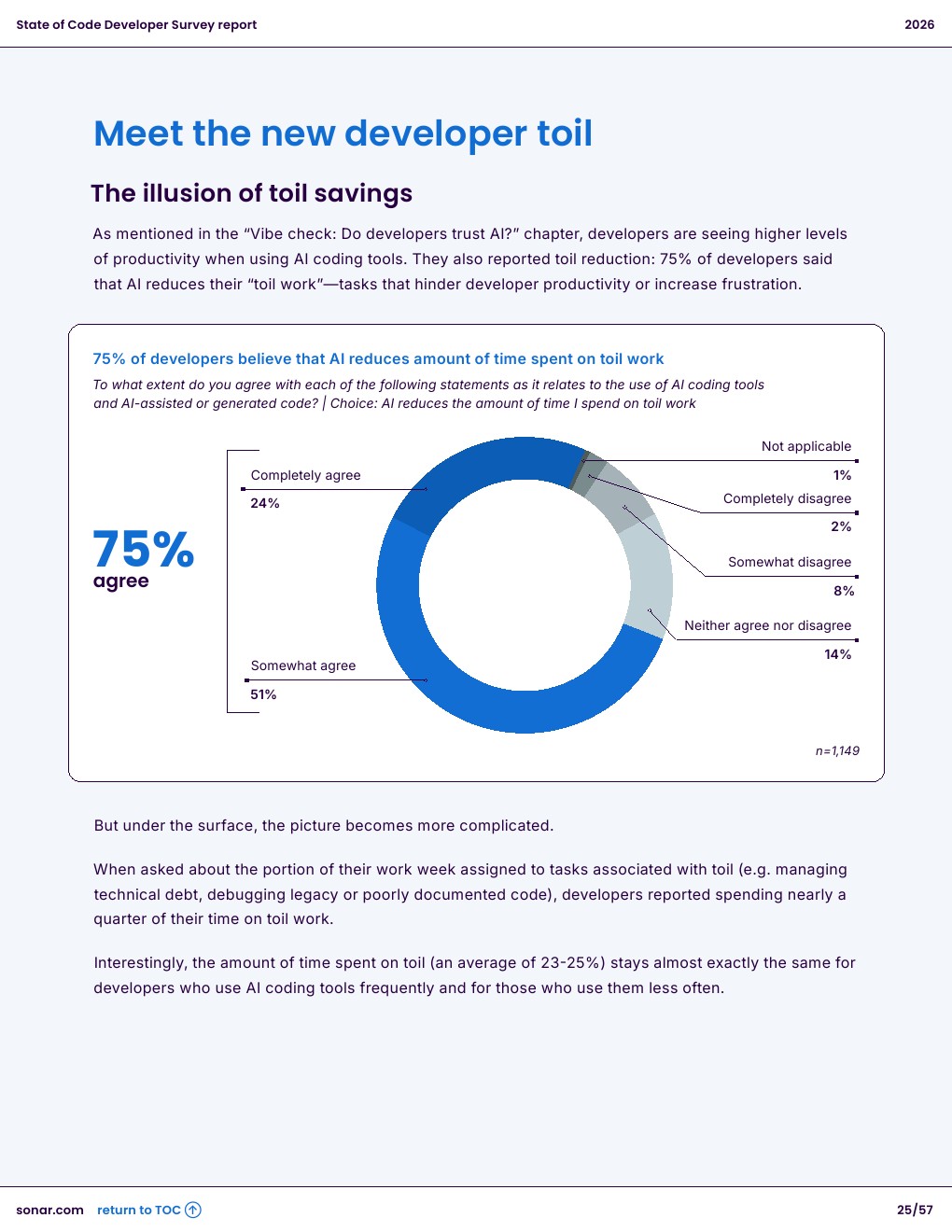

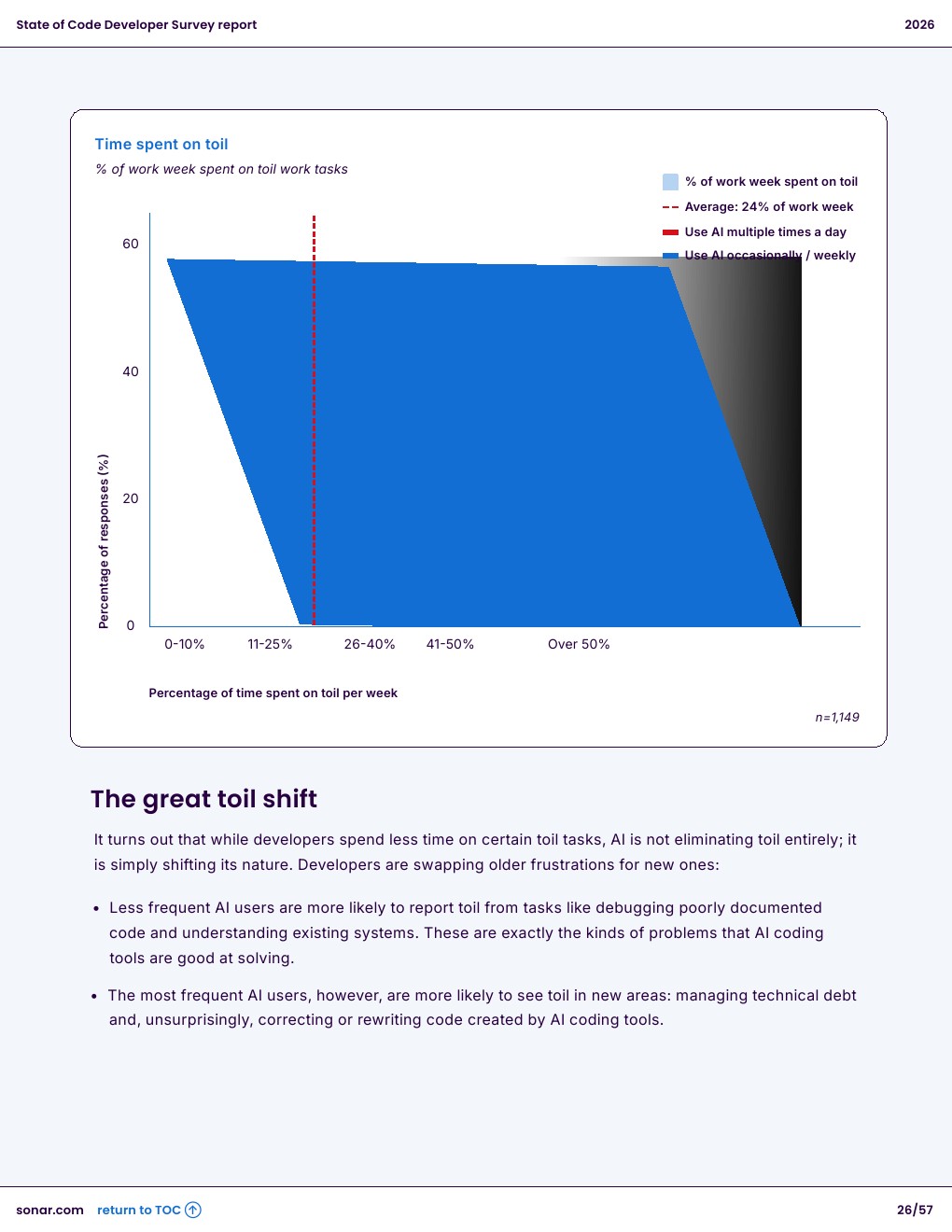

综合来看,AI并未消除开发中的重复劳动,而是将其从“编码”转移至“验证”,开发者约24%的时间仍用于低效工作。

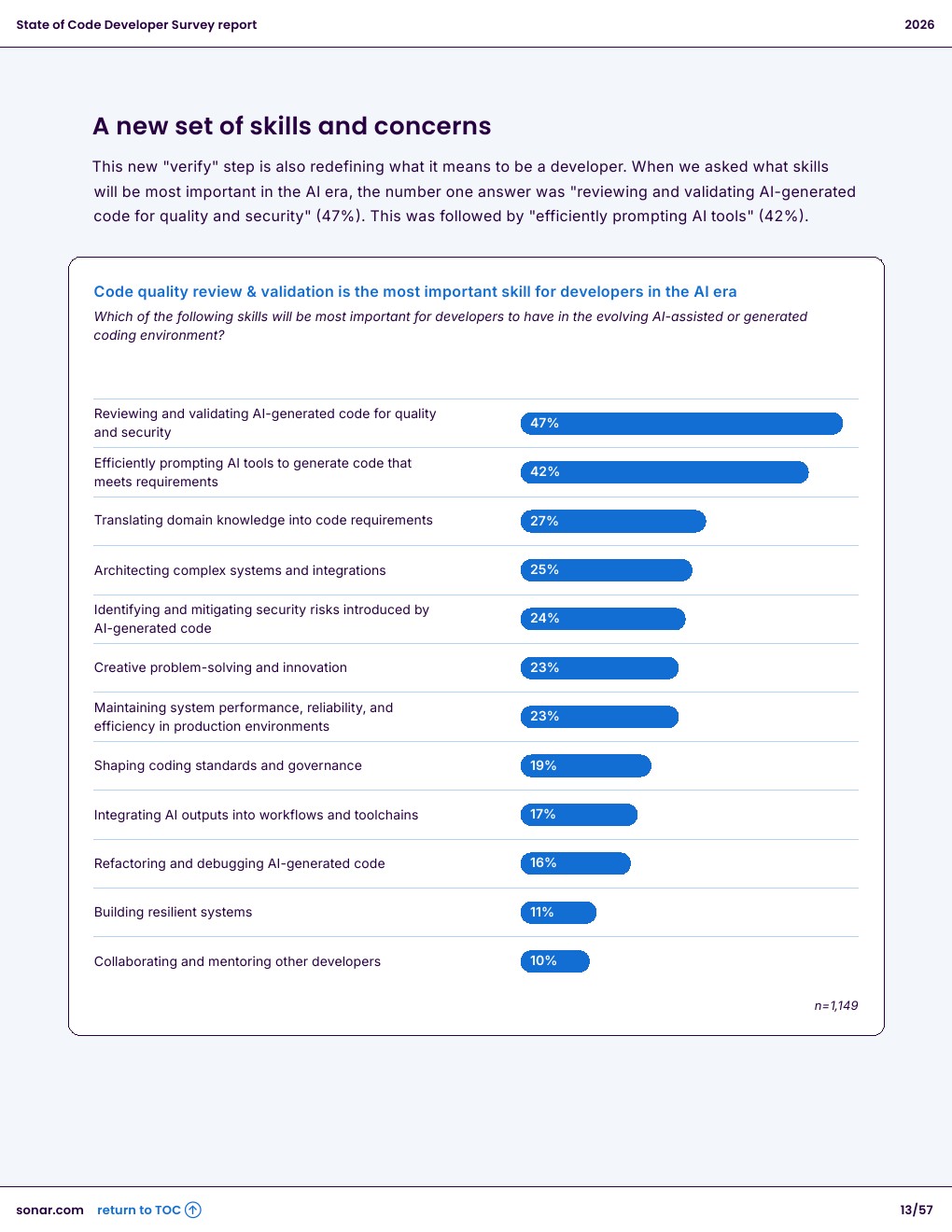

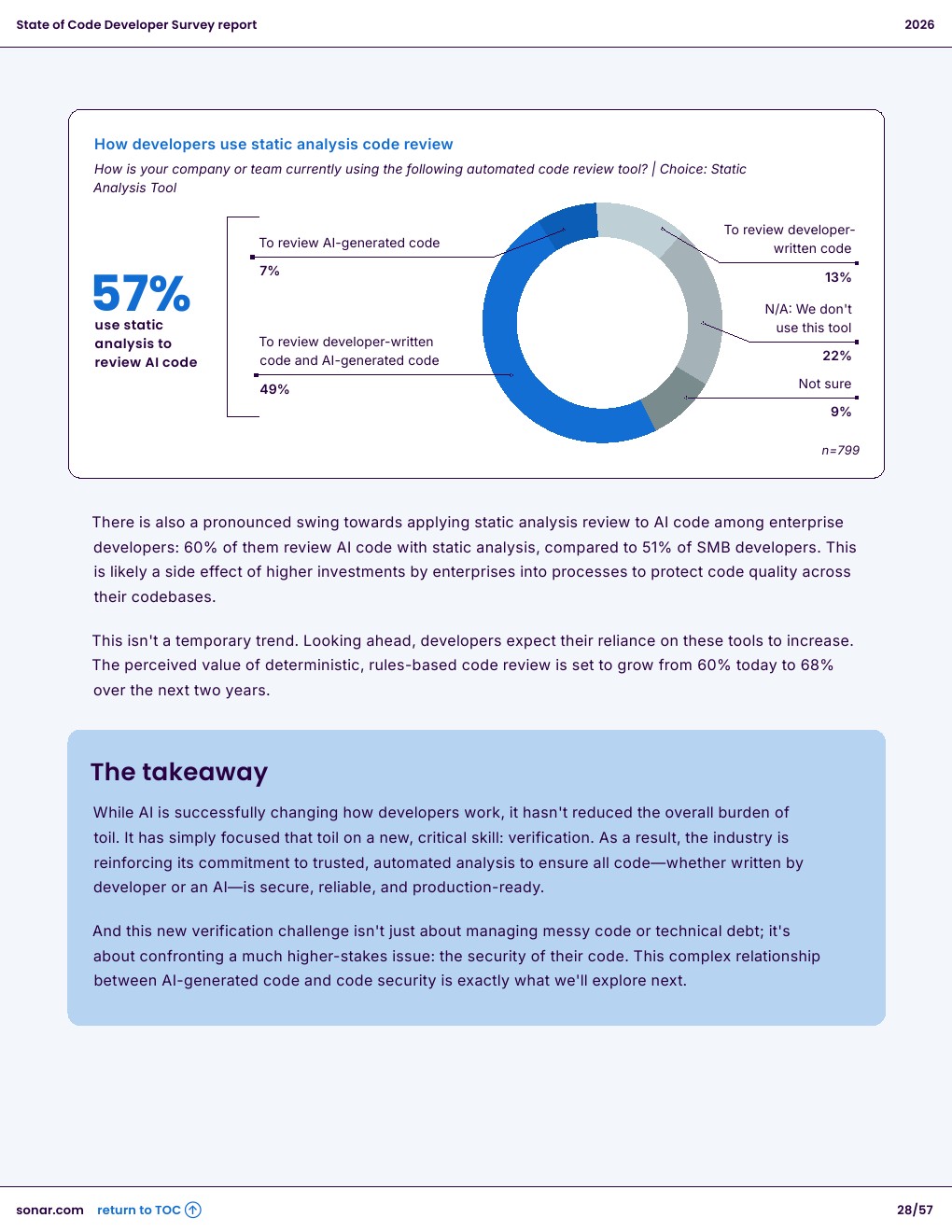

70%的开发者已依赖静态分析工具进行验证,验证能力正成为新的核心竞争力。

趋势上,AI正在推动软件开发从“生成驱动”向“验证驱动”转型,生产效率的真正提升不再取决于代码生成速度,而取决于验证体系的成熟度与自动化水平。

未来竞争将集中在“可信AI开发流程”,即如何在规模化生成代码的同时,实现质量、合规与安全的可控闭环,这将成为企业数字化能力的新分水岭。

文档链接将分享到199IT知识星球,扫描下面二维码即可查阅!

更多阅读: