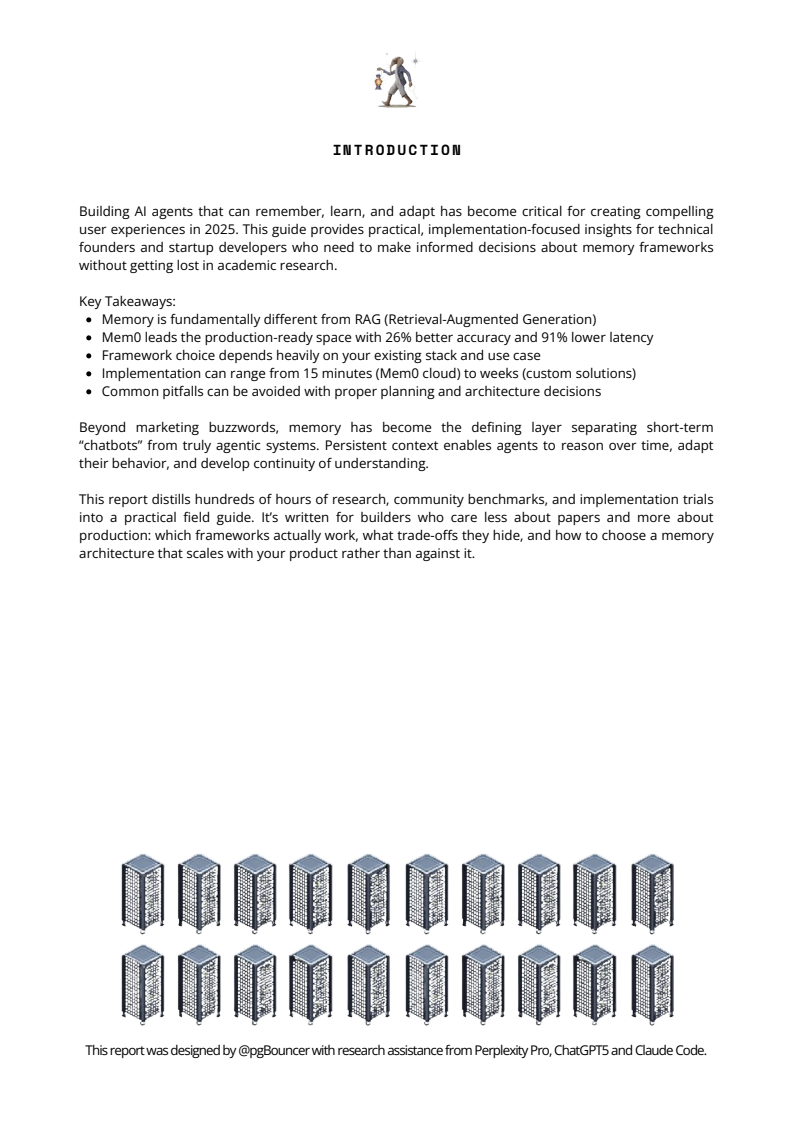

2025年,AI Agent 的核心瓶颈已不再是模型规模,而是“记忆能力”。报告指出,当前主流大模型在架构上依然是“健忘的”,每一次对话结束即清空上下文,导致70%—90%的推理 token 被反复用于重传历史信息,既推高算力成本,也破坏用户连续体验。记忆缺失直接带来三类成本:用户需反复重申目标,个性化无法累积;系统重复计算,延迟与费用上升;Agent 无法跨时间规划、自我修正或学习。这一问题已成为制约 Agent 从“聊天工具”走向“行动系统”的硬性天花板。

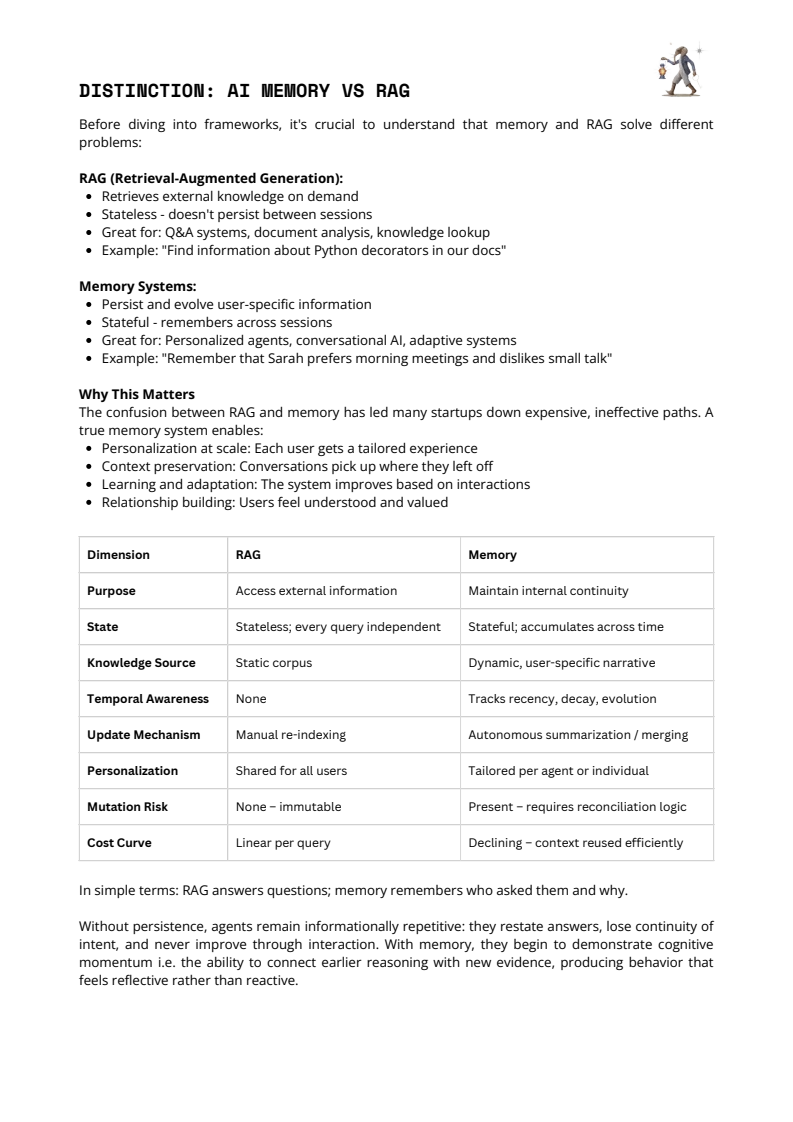

报告明确区分了“记忆”与 RAG。RAG 的本质是按需检索外部静态知识,天然无状态,适合问答与文档查询;而记忆系统强调跨会话的状态积累,记录用户偏好、历史决策与关系演化。在关键维度上,记忆具备时间感、可衰减、可合并与可遗忘特征,边际成本随复用而下降。实践表明,缺乏记忆的 Agent 行为是“反应式”的,而引入记忆后,系统开始呈现“认知动量”,能够将早期判断与新证据连接,显著提升长期决策质量。

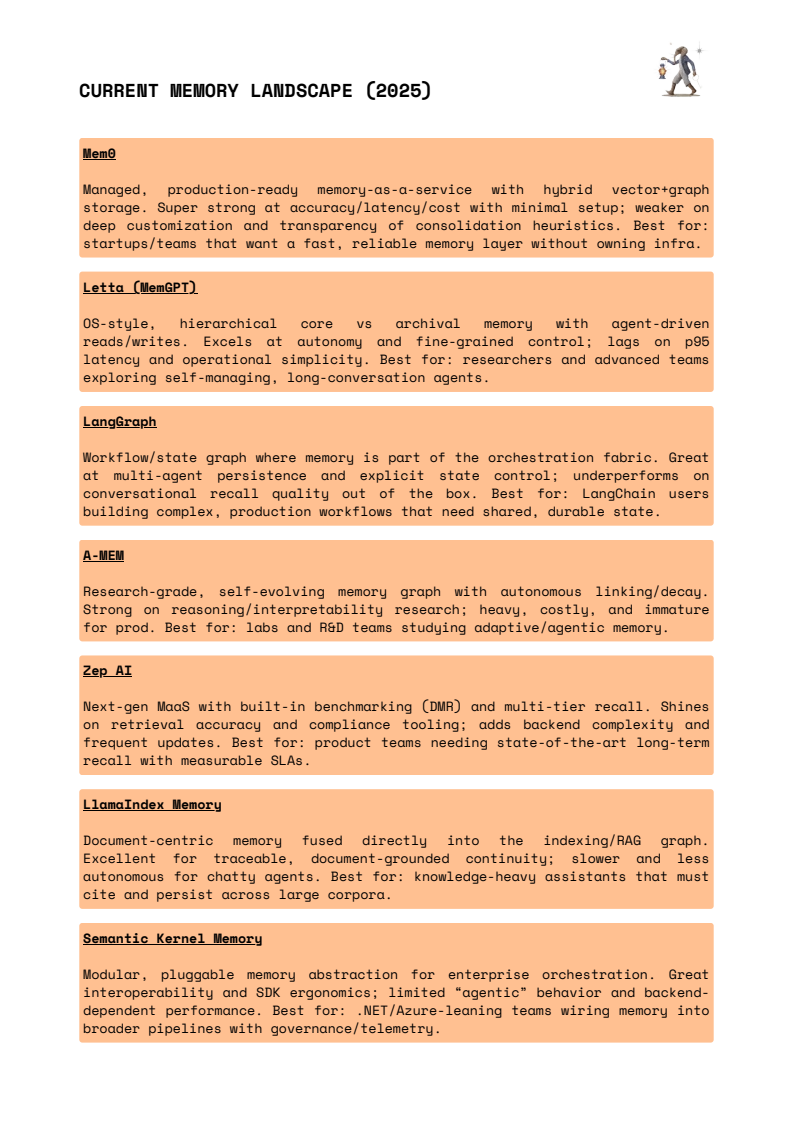

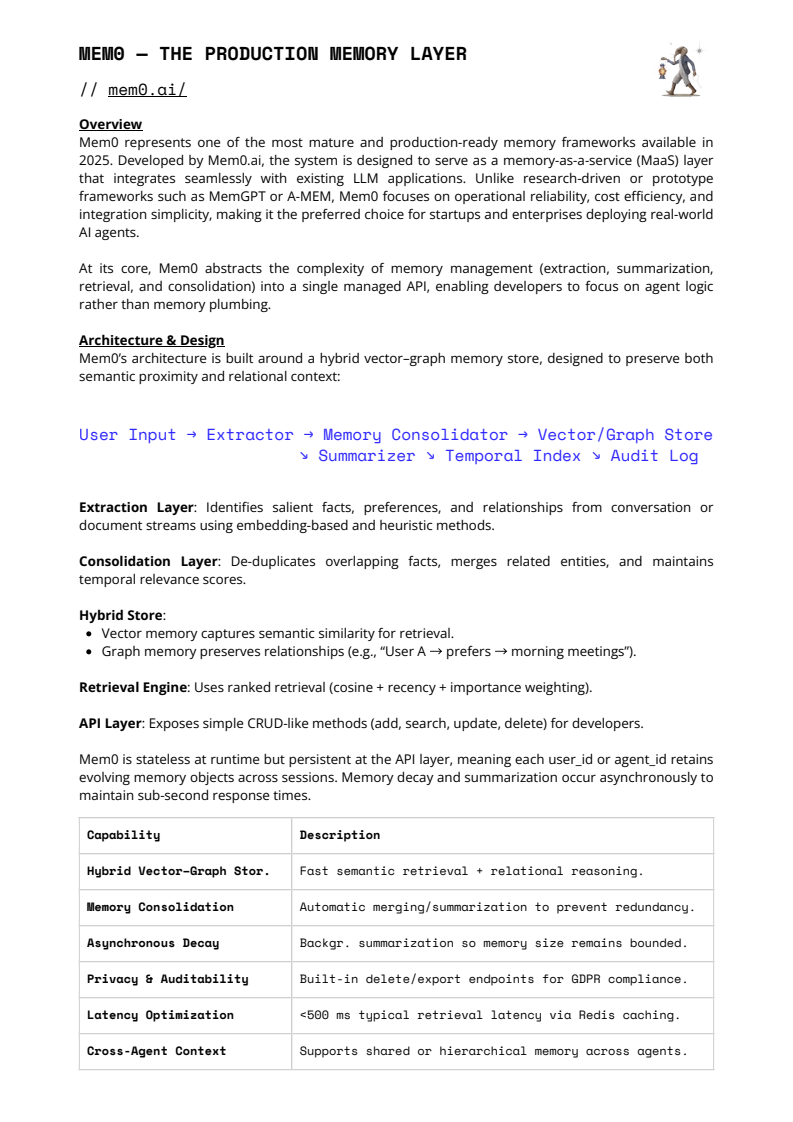

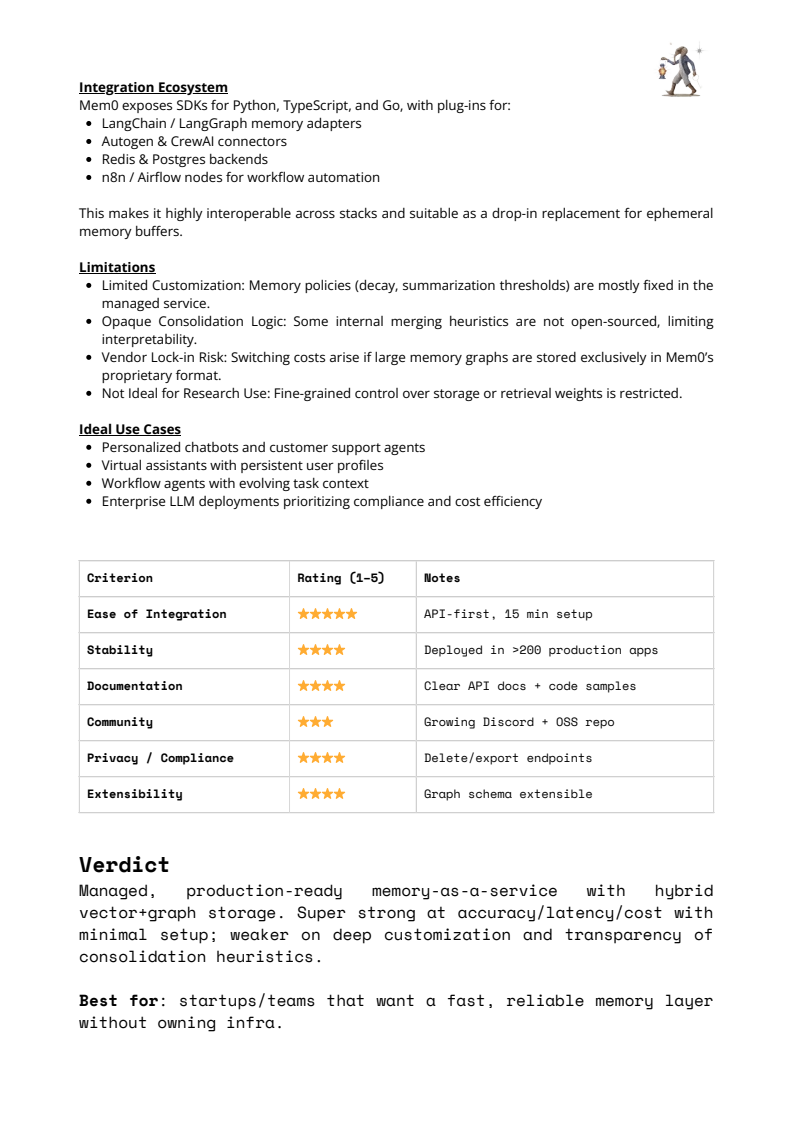

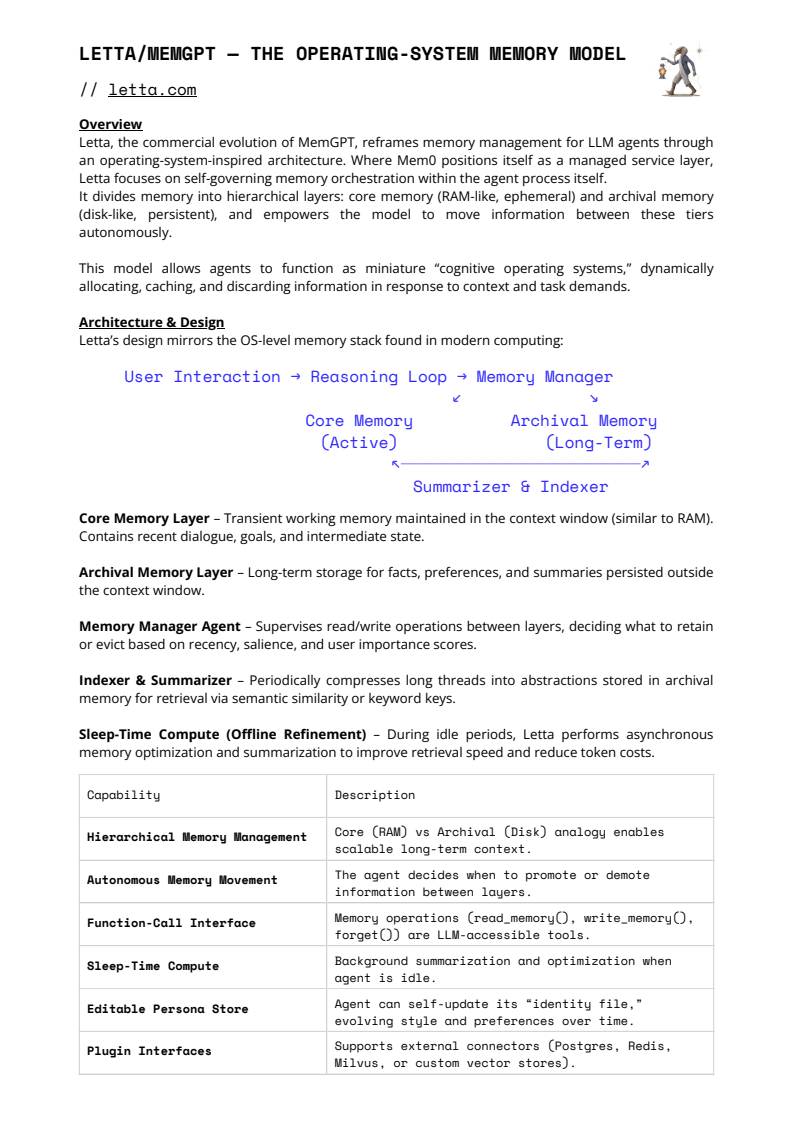

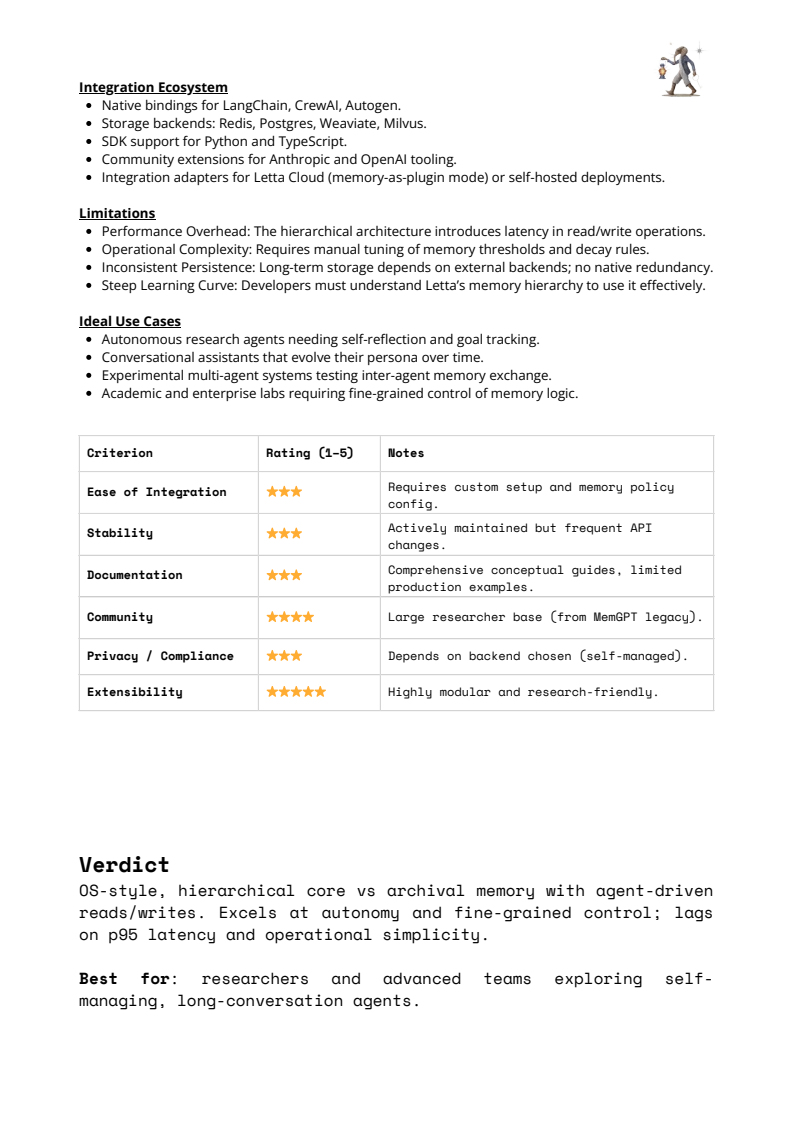

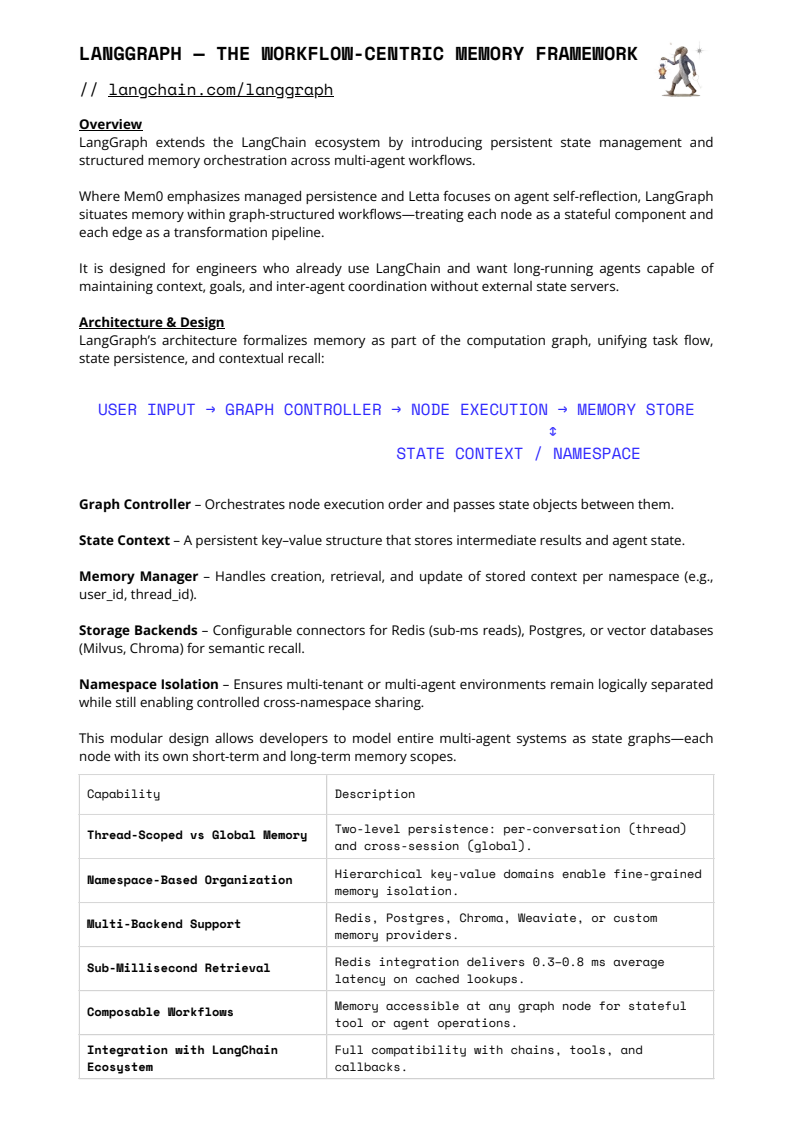

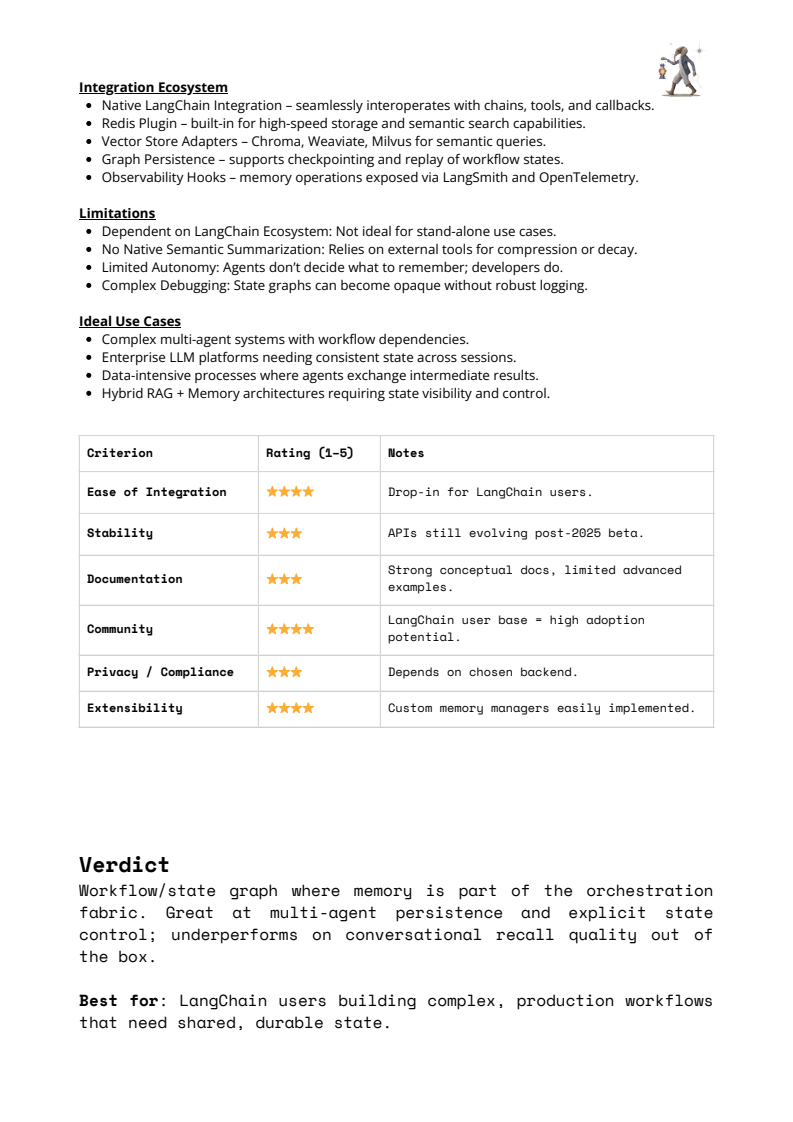

从产业格局看,2025年的记忆框架已出现清晰分层。Mem0 以混合向量+图结构和托管化服务,在生产环境中实现约26%的准确率提升与91%的延迟降低,成为效率导向型团队的首选。Zep 进一步引入多层记忆与 DMR 基准,强化可衡量性与合规能力,但系统复杂度上升。LangGraph 将记忆嵌入工作流状态,适合多 Agent 协作,却在对话召回上依赖额外优化。Letta 与 A-MEM 更偏研究取向,强调自主记忆调度或自演化图结构,但在稳定性与成本上仍难以规模化落地。

从实施成本看,记忆系统的门槛差异显著。托管式方案可在15分钟内接入,而自定义或研究级方案往往需要数周工程投入,并伴随运维与治理成本。报告强调,框架选择并不存在“最优解”,而是高度依赖现有技术栈、延迟容忍度、合规要求与产品阶段。盲目将 RAG 当作记忆替代,往往导致高投入、低复利的路径依赖,是当前初创团队最常见的结构性误判之一。

趋势上看,Agent 记忆正从“存储层”演进为“认知基础设施”。未来两年,记忆将与评测基准、隐私治理和多 Agent 协同深度耦合,成为区分普通应用与真正 Agentic 系统的决定性因素。随着记忆复用率提升,推理的长期边际成本有望持续下降,而具备连续人格与经验轨迹的 Agent,将在用户黏性与商业化效率上形成显著分化优势。

文档链接将分享到199IT知识星球,扫描下面二维码即可查阅!

更多阅读: