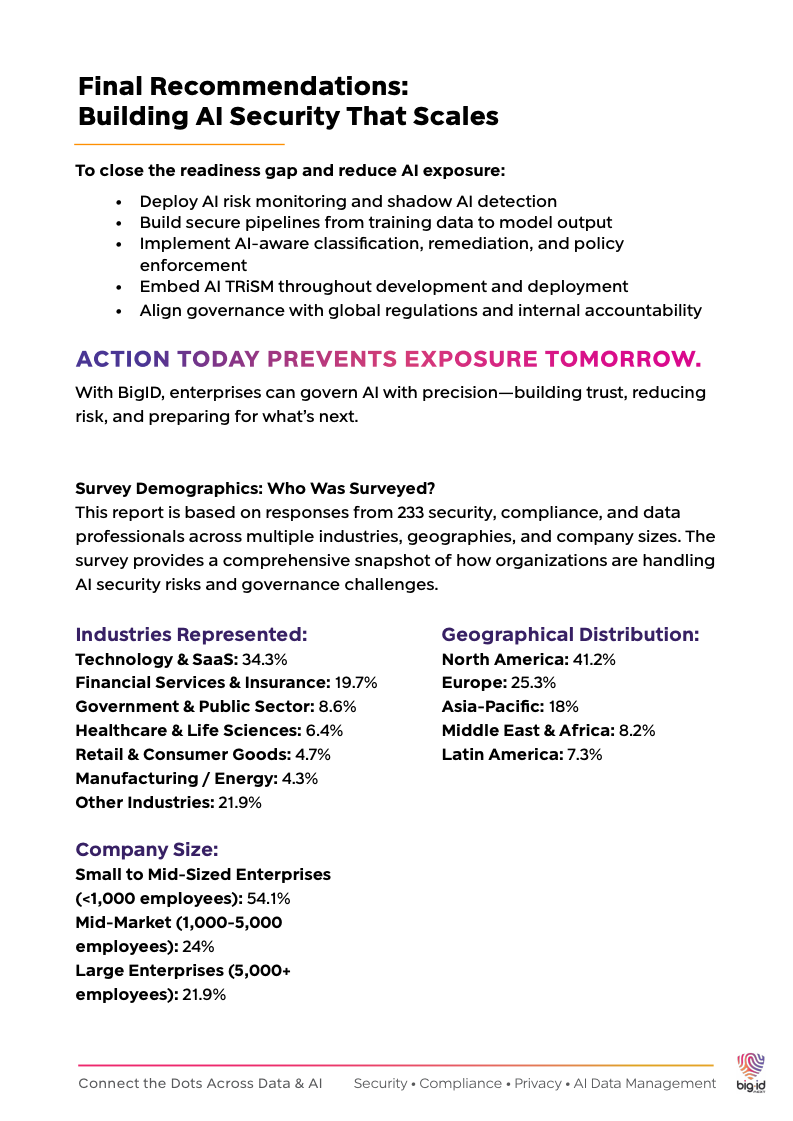

企业在加速拥抱AI的同时,治理体系却明显掉队。调查显示,93.2%的机构对AI驱动的数据安全缺乏充分信心,69.5%将AI触发的数据泄漏列为2025年的头号威胁,超过八成企业对新兴AI监管未做好准备。大量企业在快速引入模型、搭建AI流程,却未同步建立数据识别、访问控制和风险监测机制,使AI从增长引擎演变为潜在的系统性风险源。

从风险认知看,39.5%的企业仍处在早期风险评估阶段,24%虽意识到风险却没有采取行动,甚至5.6%完全没有可见性。这意味着近七成企业对AI与敏感数据的交互缺乏实质性管理。在AI系统日益融入业务核心流程的背景下,这种“意识与行动脱节”将带来数据外泄、模型滥用、访问越权等连锁反应,监管压力亦随之加重。

AI带来的新型安全威胁正在急剧扩大。69.5%的企业担忧AI驱动的数据泄漏,58.4%担心非结构化数据暴露,48.5%对日益扩散的“影子AI”深感不安。影子AI特别值得警惕,它绕过官方管控,使企业在毫不知情的情况下暴露于未授权模型之下;而模型访问风险与非结构化数据扩散,进一步增加了供给链式泄漏的可能性。

更令人关注的是,47.2%的企业仍未配置任何AI安全控制,只有21%建立了AI专属的数据分类与保护体系。传统安全工具无法覆盖AI推理端点、训练数据流与模型调用逻辑,导致企业即便拥有成熟的网络安全体系,也难以对AI风险形成对等的控制力。这种治理真空让安全成本被动累积,最终在监管问责时集中暴露。

监管方面,54.9%的企业虽开始准备但仍不明确方向,25.3%尚未起步,总计超过80%对AI监管无充分准备。随着欧盟AI法案与美国行政令落地,企业不仅要证明透明性,还需为用途边界、数据溯源、模型偏差承担责任。在信任层面,64.4%的企业仅“有所信心”,而31.8%完全不确定模型是否错误使用敏感数据。这表明AI TRiSM体系(信任、风险、安全管理)在多数企业仍属缺位。

行业差异同样显著。金融行业中62%缺乏AI专属数据保护;医疗机构有52%难以跟上合规要求;零售业48%无法监测AI对客户PII的使用;而科技行业虽创新领先,却有42%没有明确的AI风险策略。这进一步说明,行业越依赖数据,AI风险越容易在体系内部放大。

未来趋势值得警醒。2025年企业最看重的议题仍是治理与可见性,其中36.1%将合规列为优先事项,30%聚焦风险透明度。然而,在数据泄漏与模型滥用不断攀升的背景下,实际的预防控制部署却严重落后。随着AI在企业内部渗透到更多流程,风险不再局限于单点,而将呈现“规模化、链式、实时化”的特征。未来3至5年,企业的竞争力将不仅取决于AI部署速度,更取决于能否同步构建覆盖模型、数据与监管全链路的AI治理体系。治理缺口越久未补,风险成本便越呈指数级累积。

文档链接将分享到199IT知识星球,扫描下面二维码即可查阅!

更多阅读: