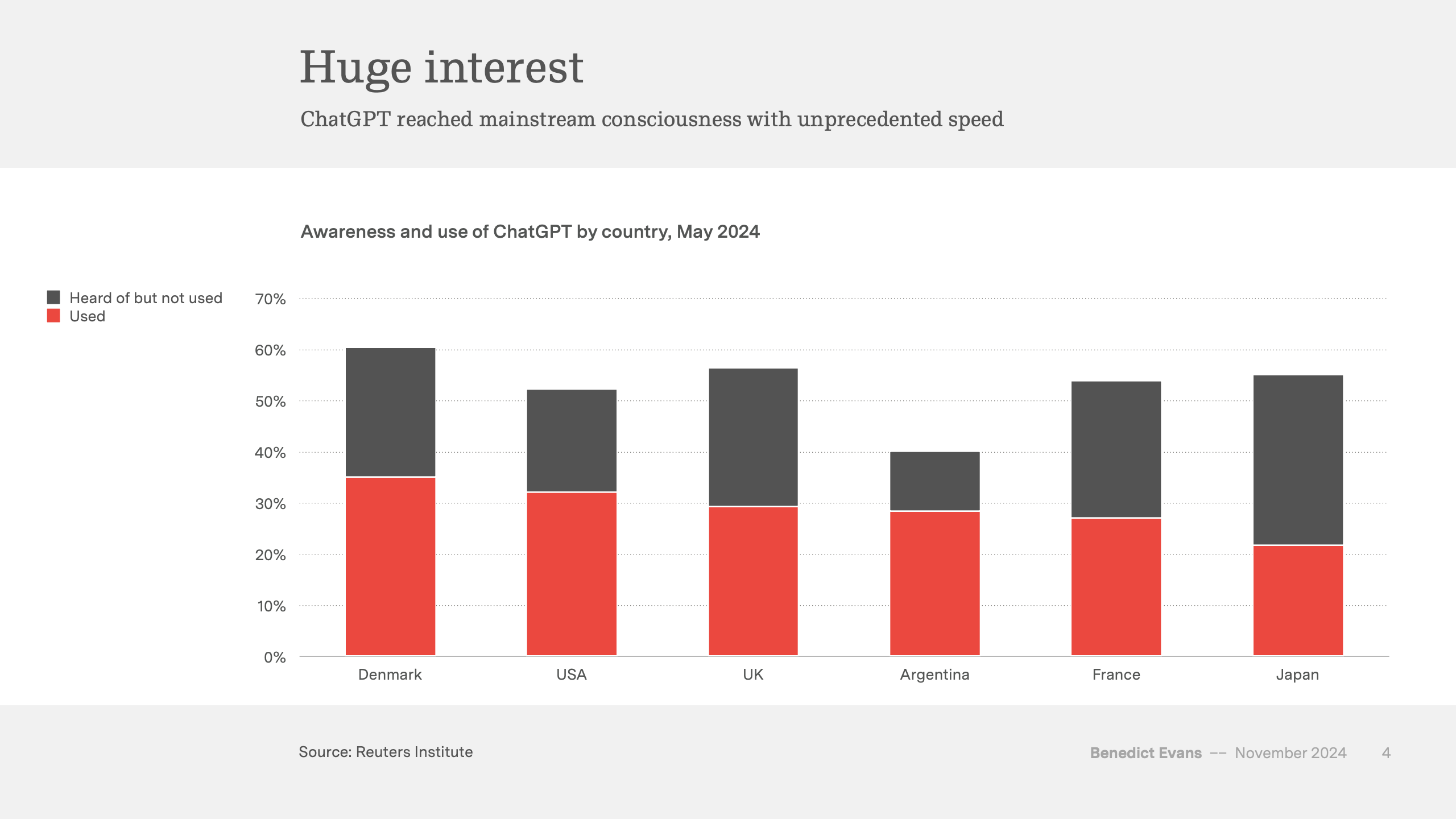

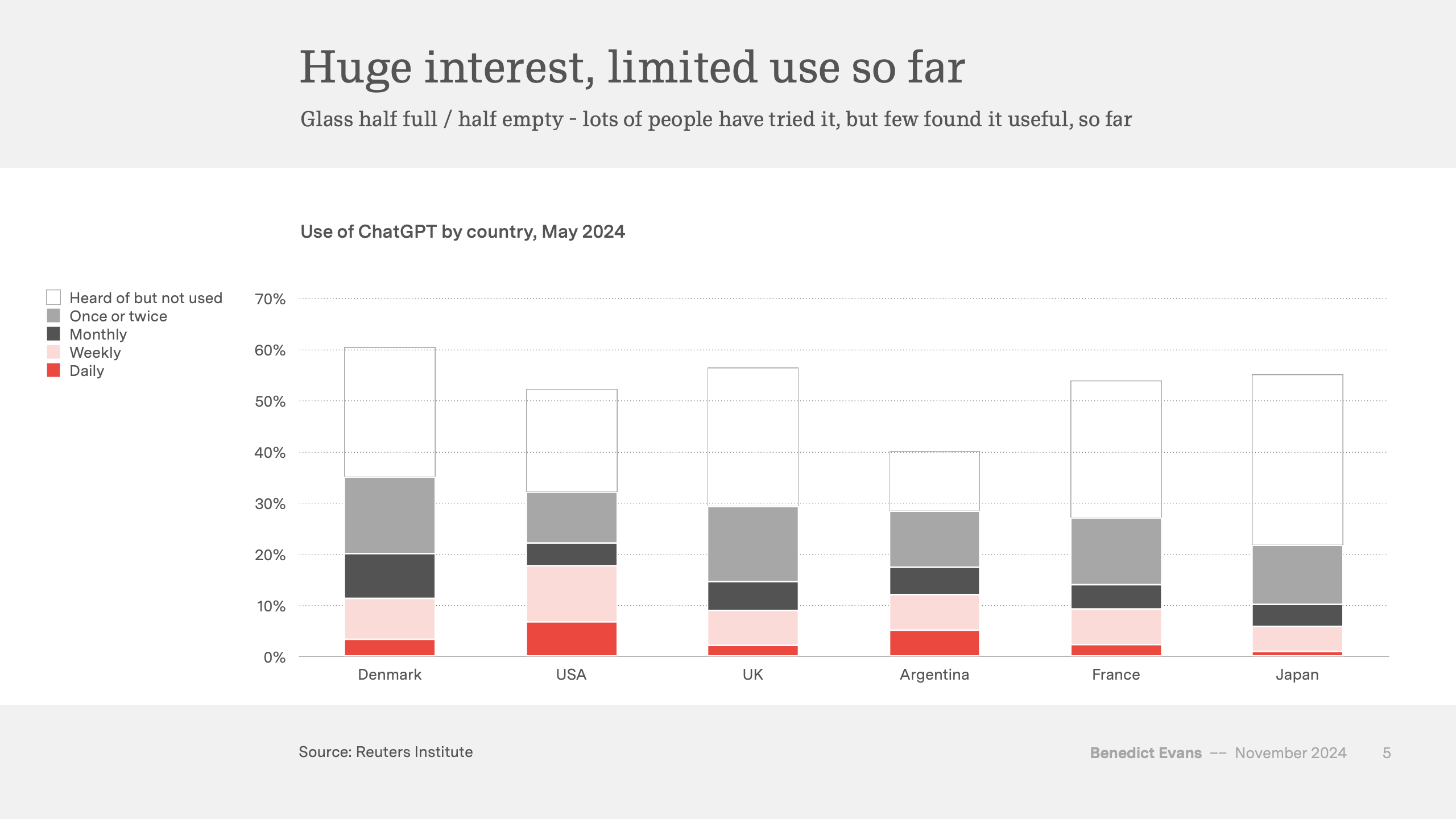

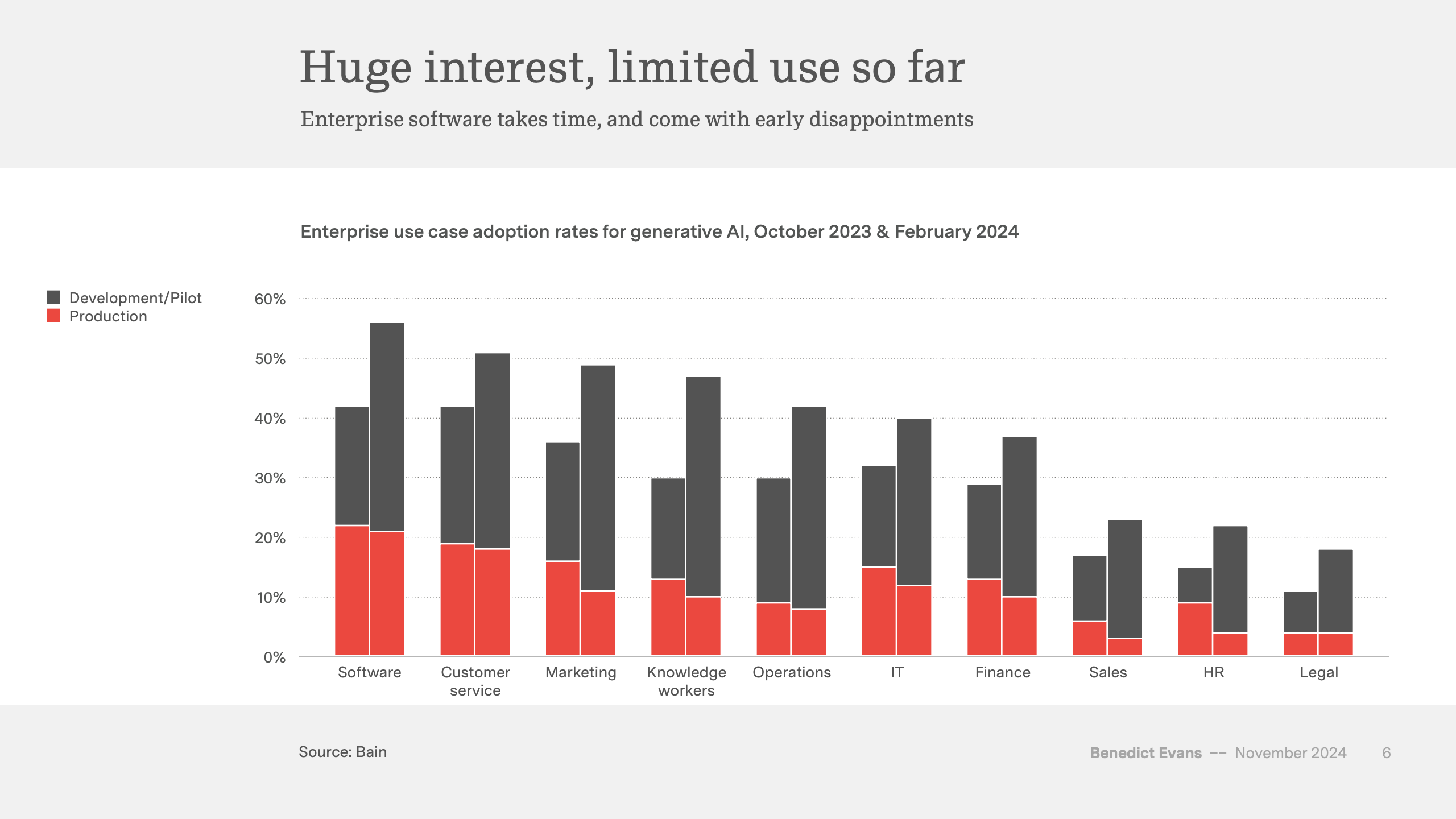

生成式人工智能在2023年至2024年经历了类似互联网与智能手机的技术拐点,其扩散速度前所未有。调查显示,截至2024年5月,美国、英国、日本等主要国家中,超过60%的公众听说过ChatGPT,但真正形成日常使用的比例在10%以下,体现出“高认知、低渗透”的典型早期技术特征。同时,全球大型企业的AI落地亦呈现类似趋势。Bain数据显示,2023至2024年间,企业在客服、软件开发、营销等环节测试AI的比例快速上升,但真正进入生产环境的仅20%至30%。

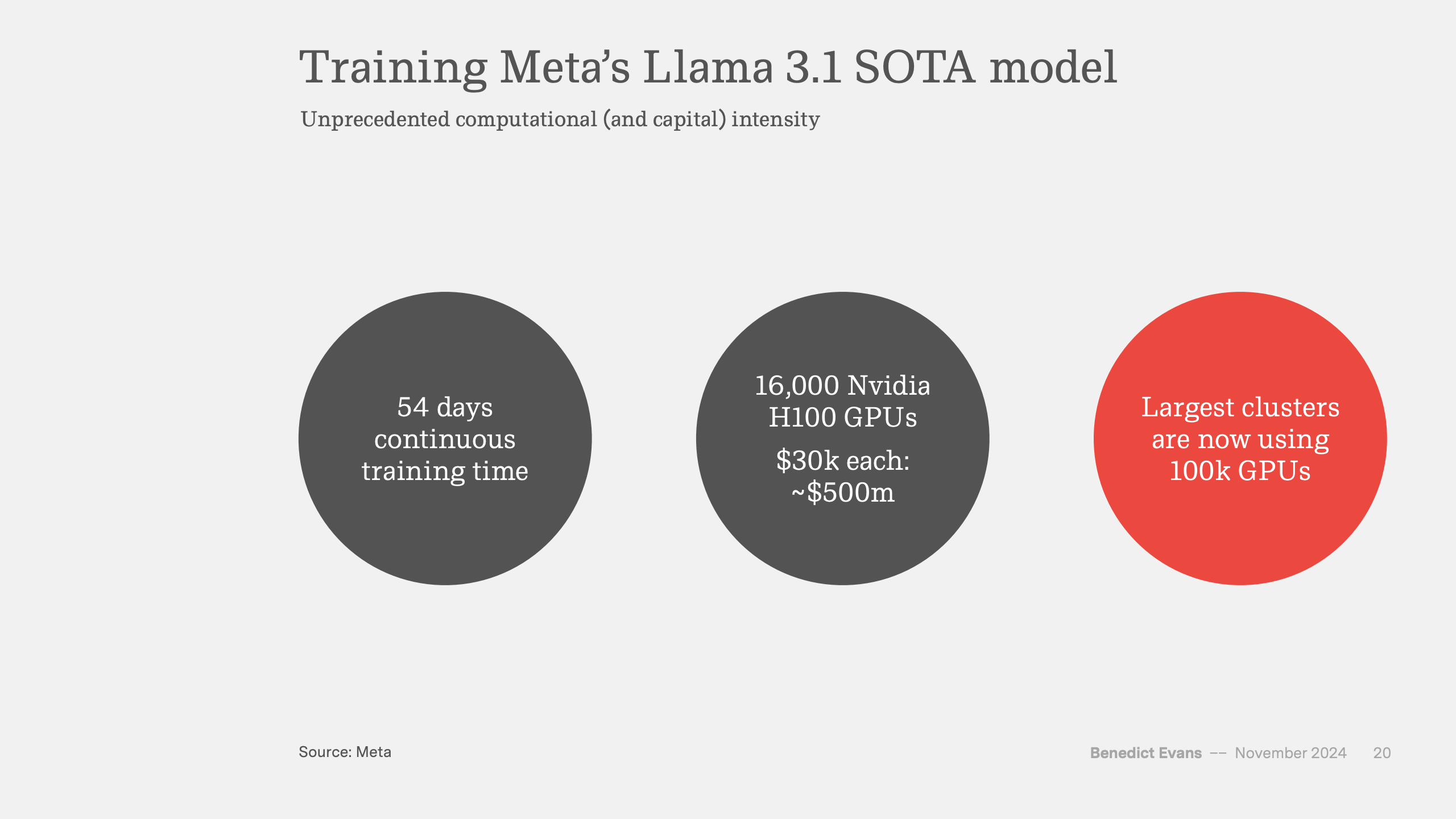

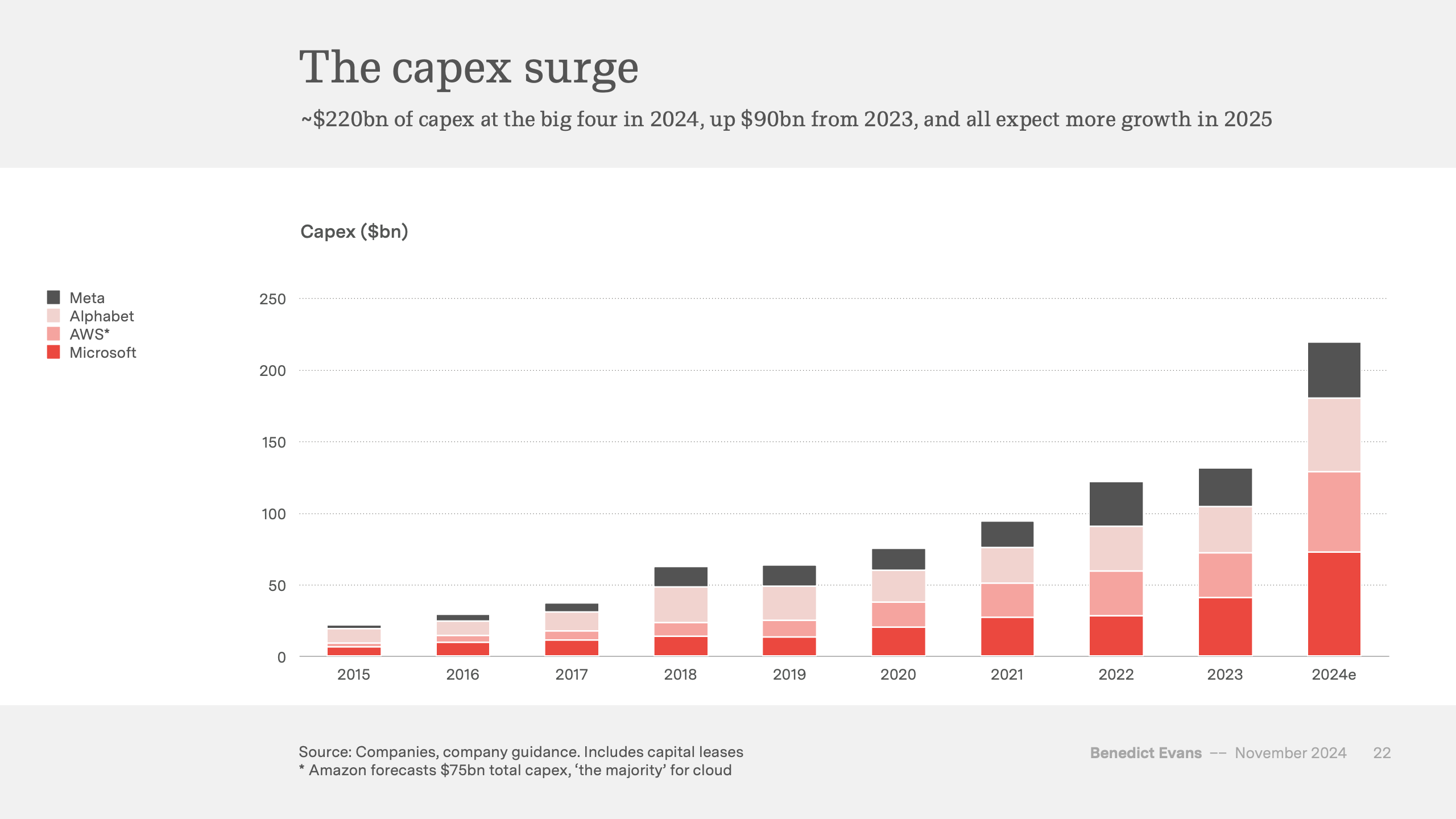

与低渗透相反的是高投入。微软、亚马逊、Alphabet与Meta四大巨头在2024年的资本开支合计约2200亿美元,较2023年增长900亿美元,其中亚马逊预计全年投入750亿美元,且大部分用于云与AI基础设施。Meta一款SOTA模型Llama 3.1需要连续训练54天、使用1.6万块H100 GPU,硬件成本约5亿美元。巨头竞相扩容算力,使AI成为史上资本密度最高的科技浪潮。

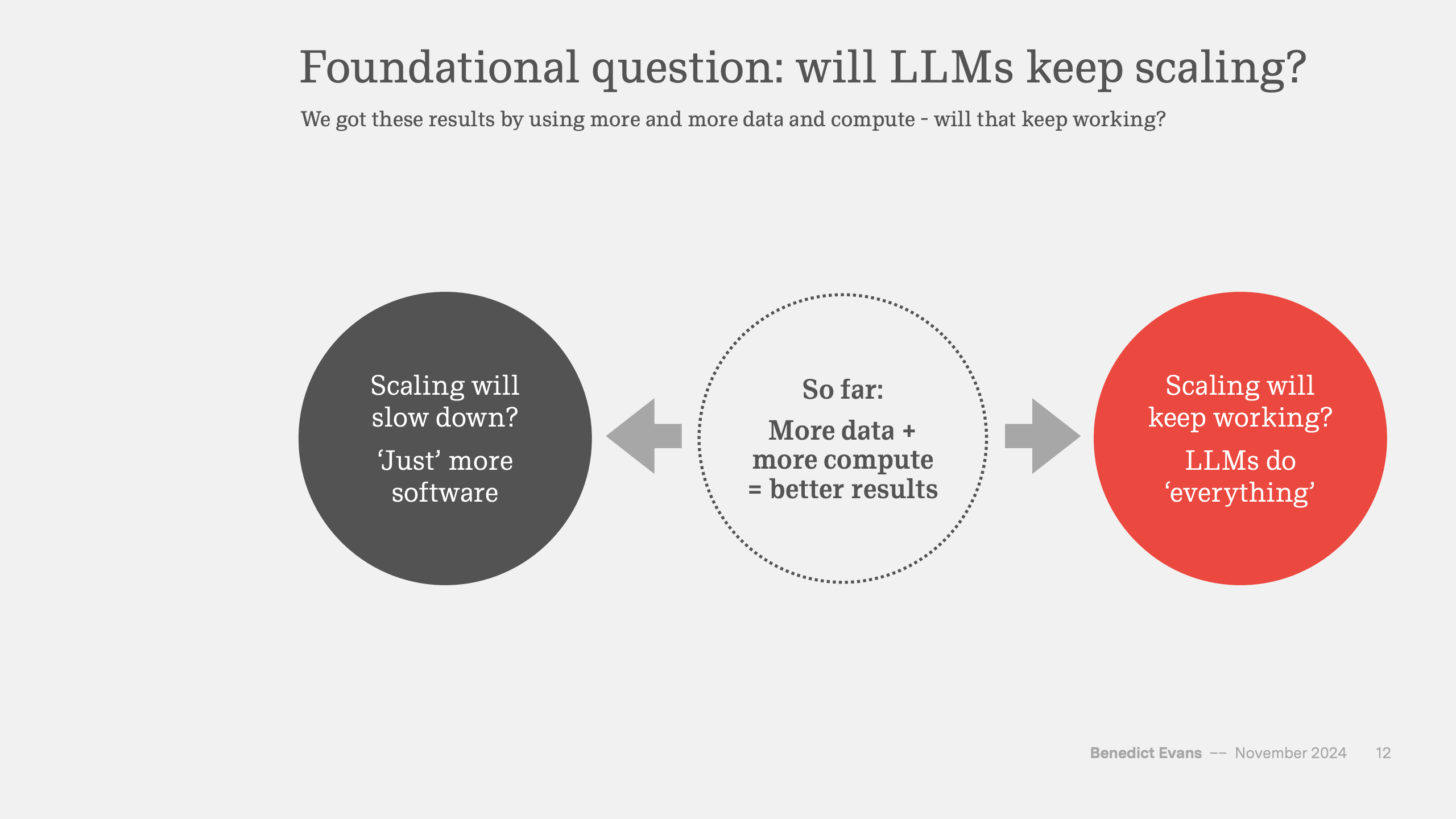

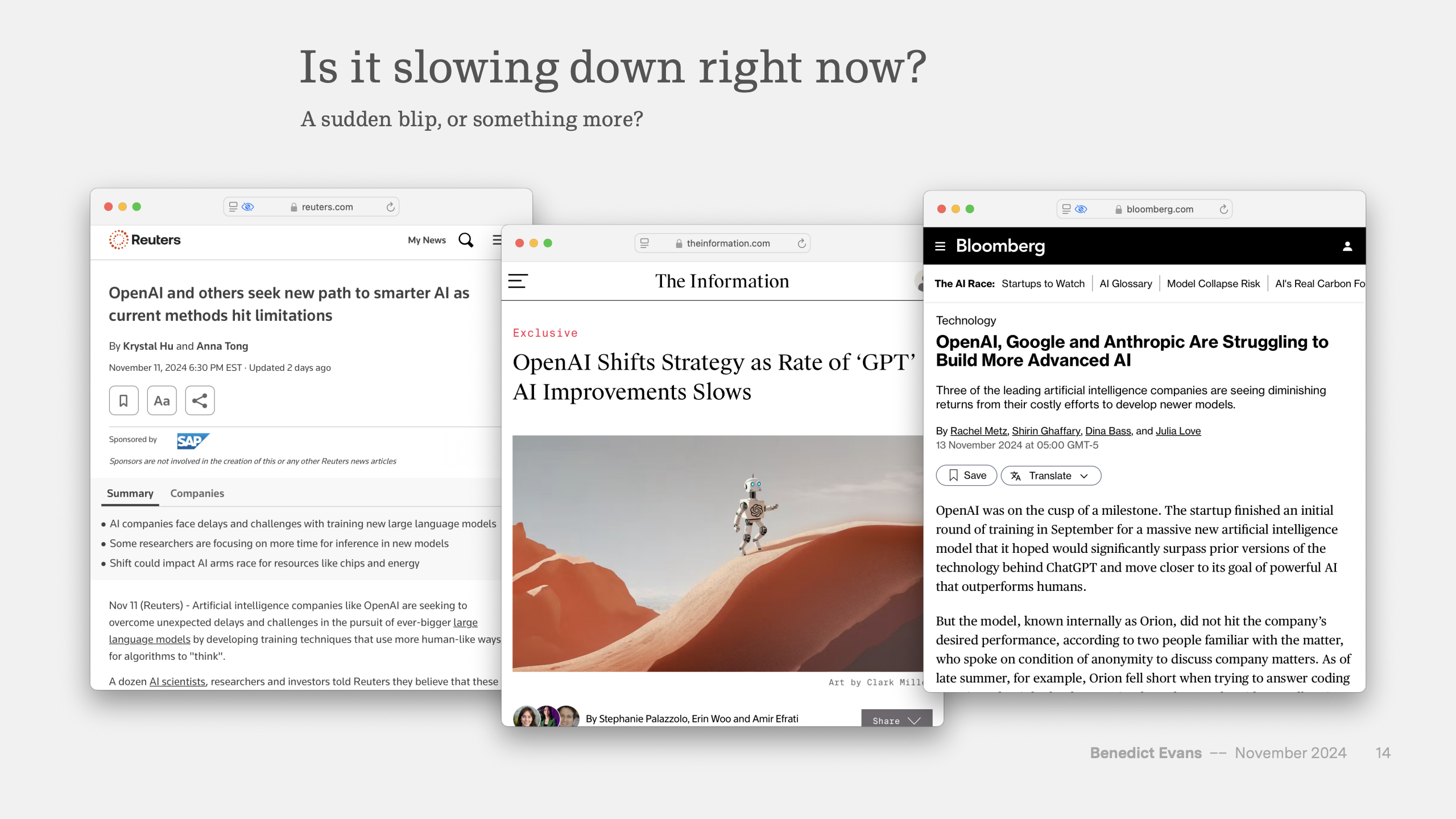

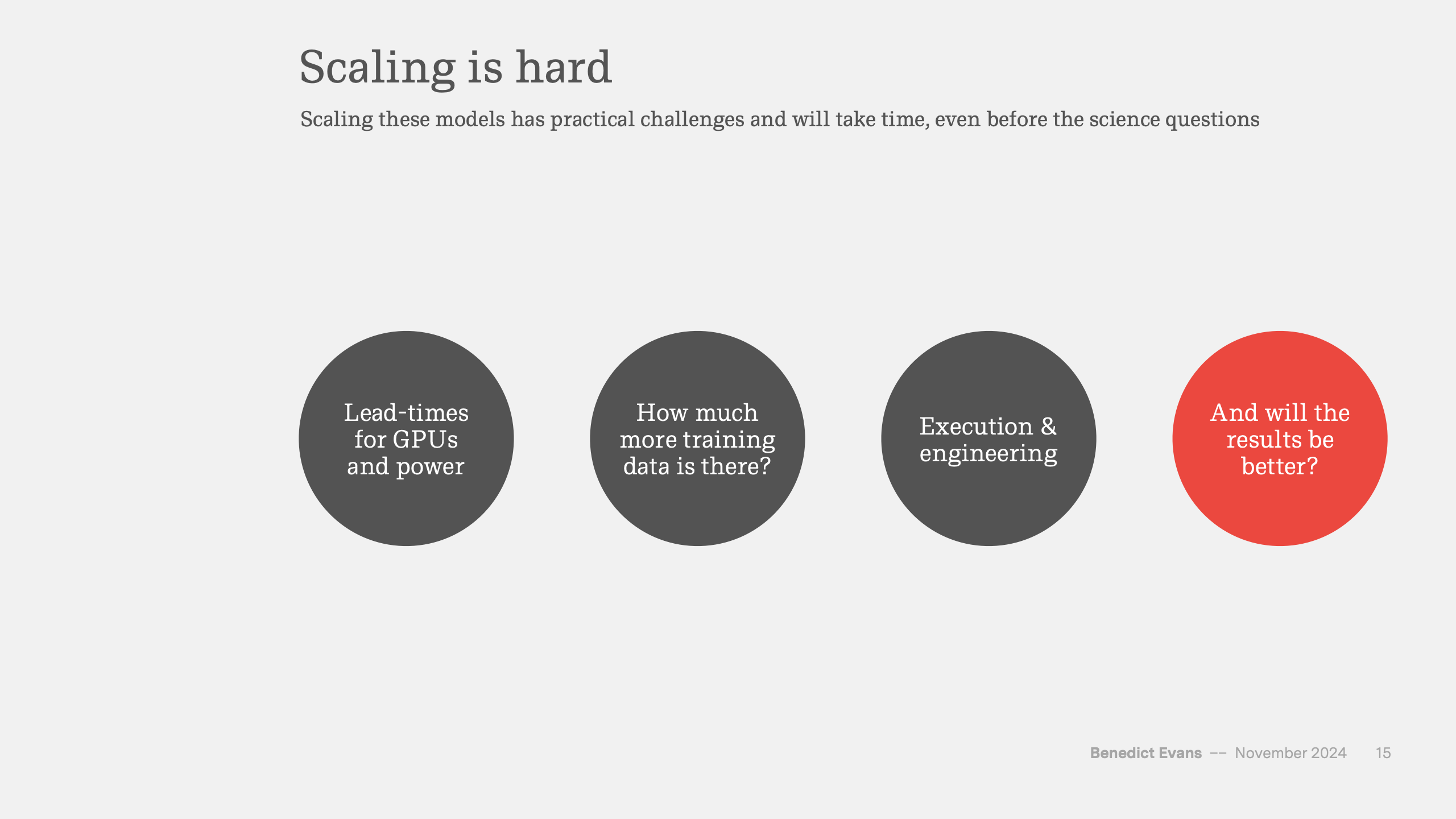

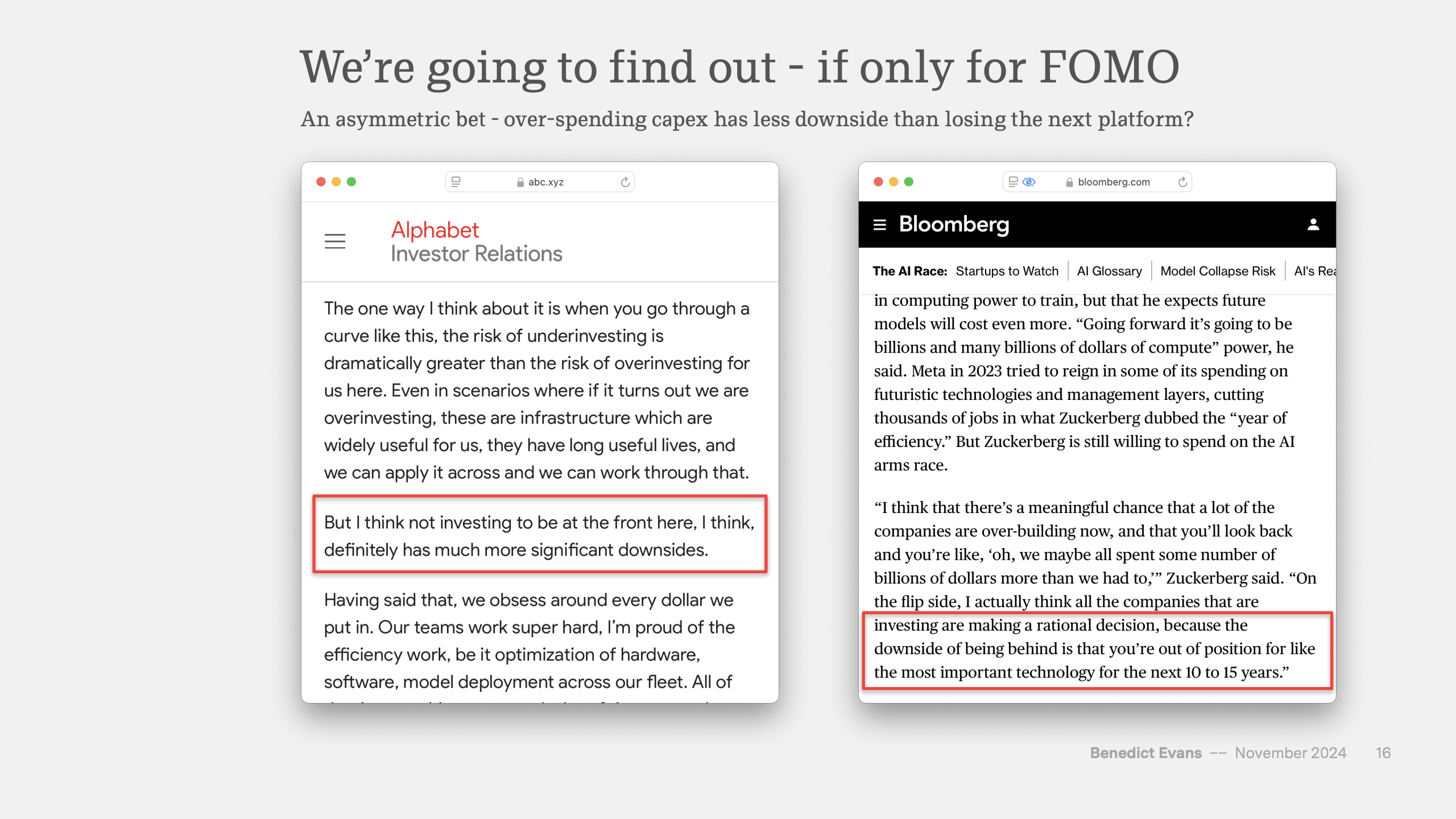

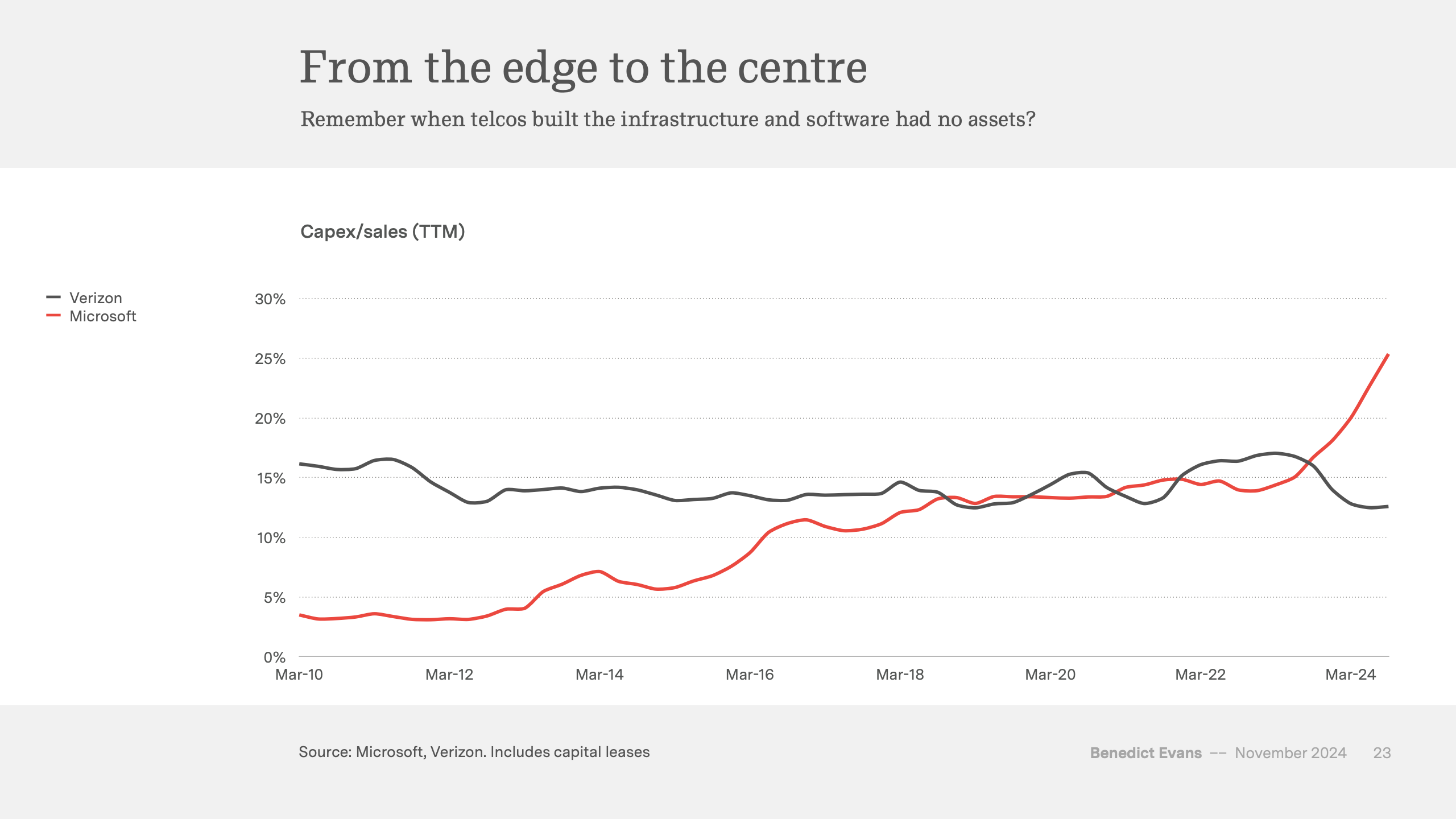

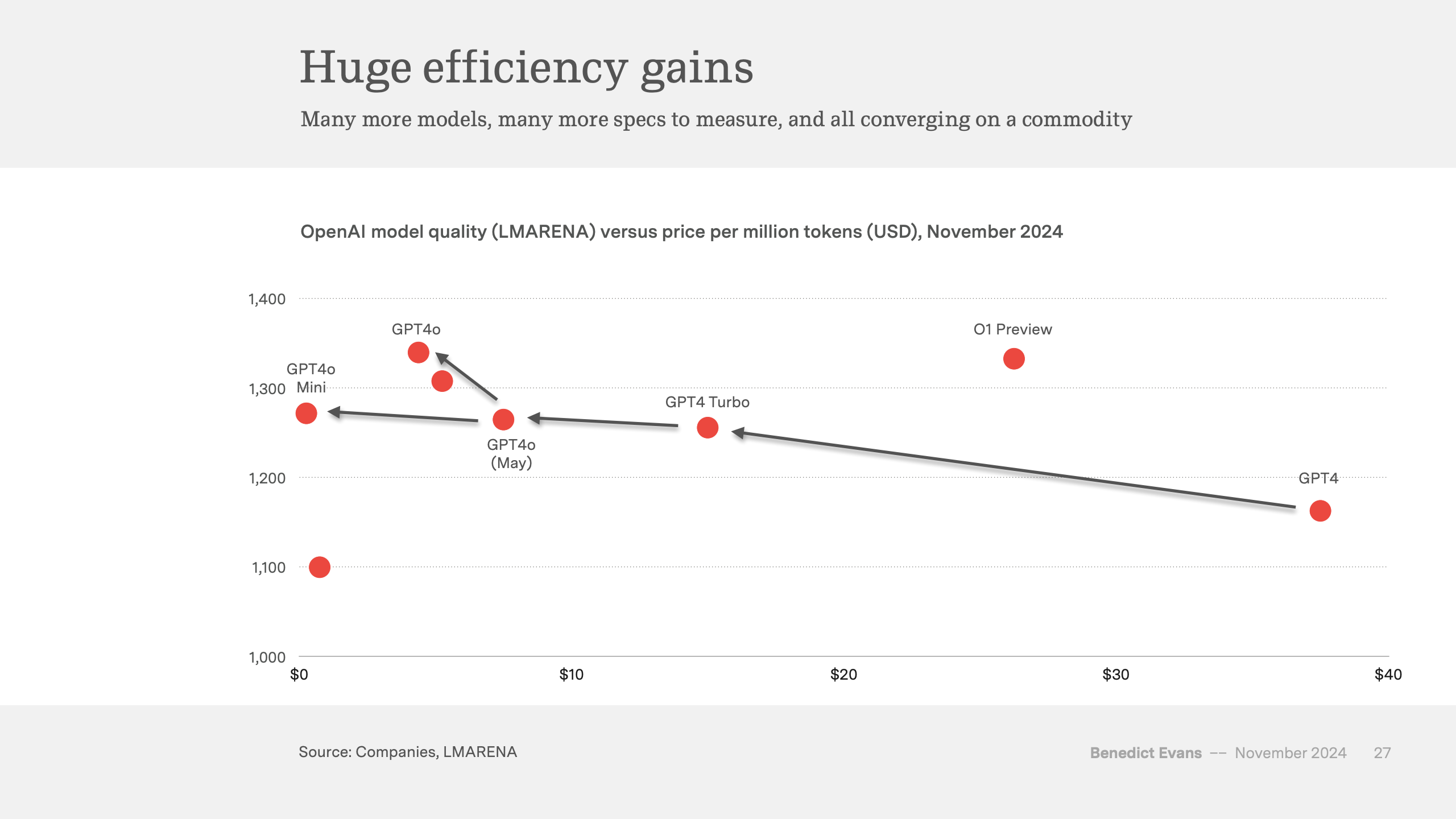

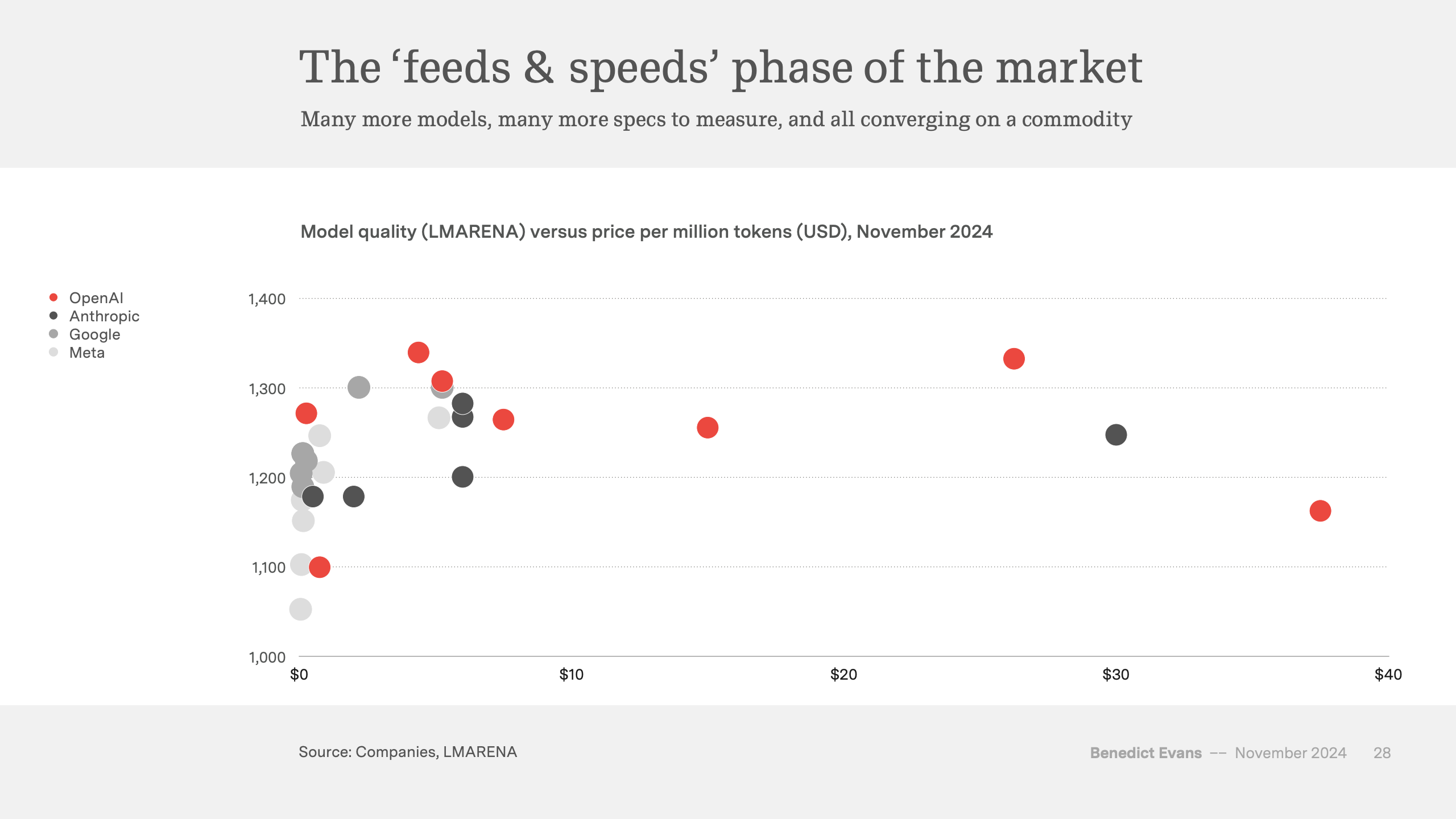

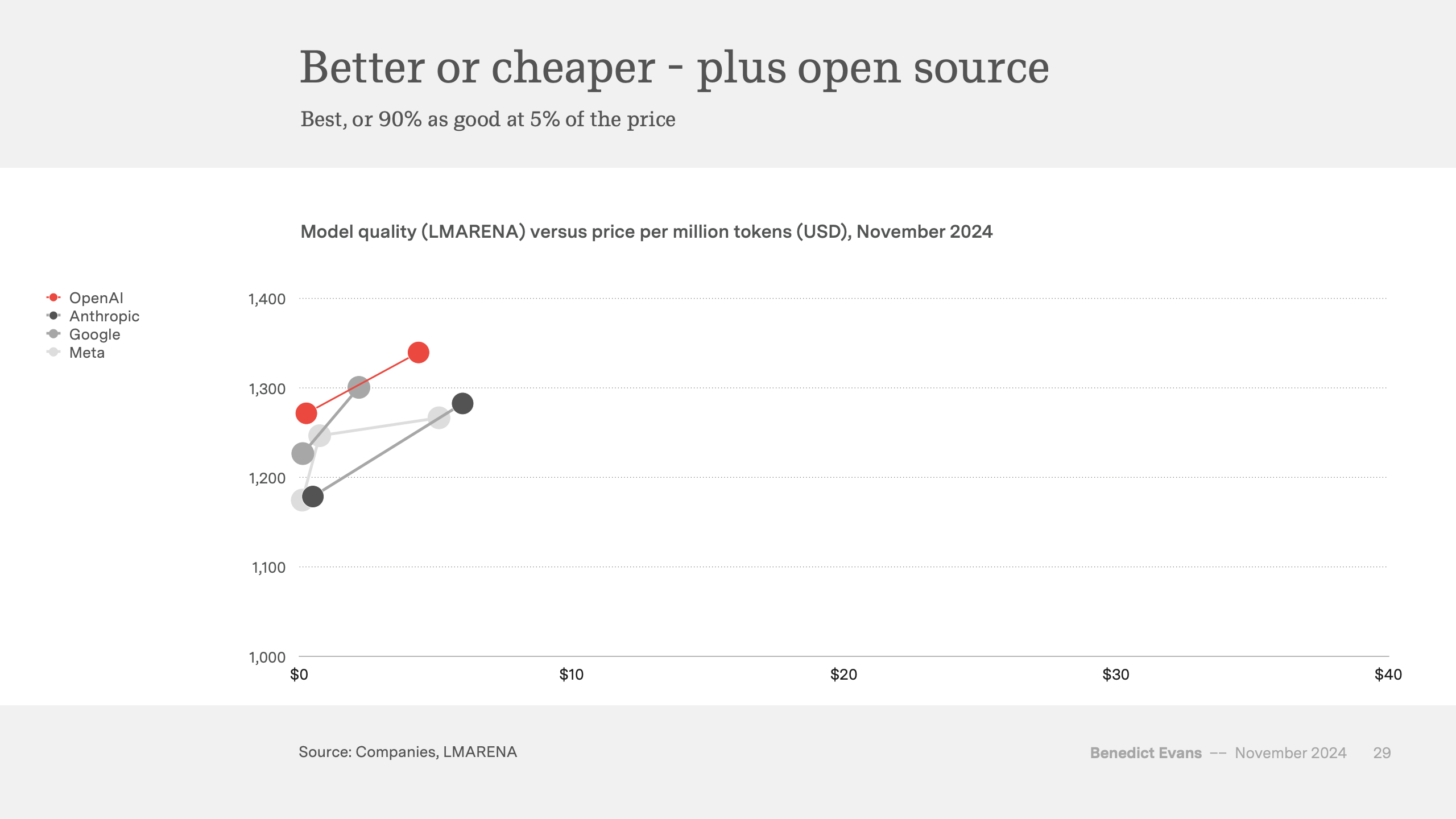

然而,大规模投入并未保证模型持续线性提升。2024年多家机构报道模型改进速度放缓,引发行业争议。谷歌联合创始人布林提醒“无法盲目外推三位数量级”,但微软CTO Kevin Scott认为“六年来的趋势将继续”,反映行业在“规模还能否继续生效”这一核心问题上尚无共识。与此同时,模型成本的陡增令AI从“轻资产互联网模式”回归“重资本基础设施模式”,也为价格战和开源路线提供了土壤。

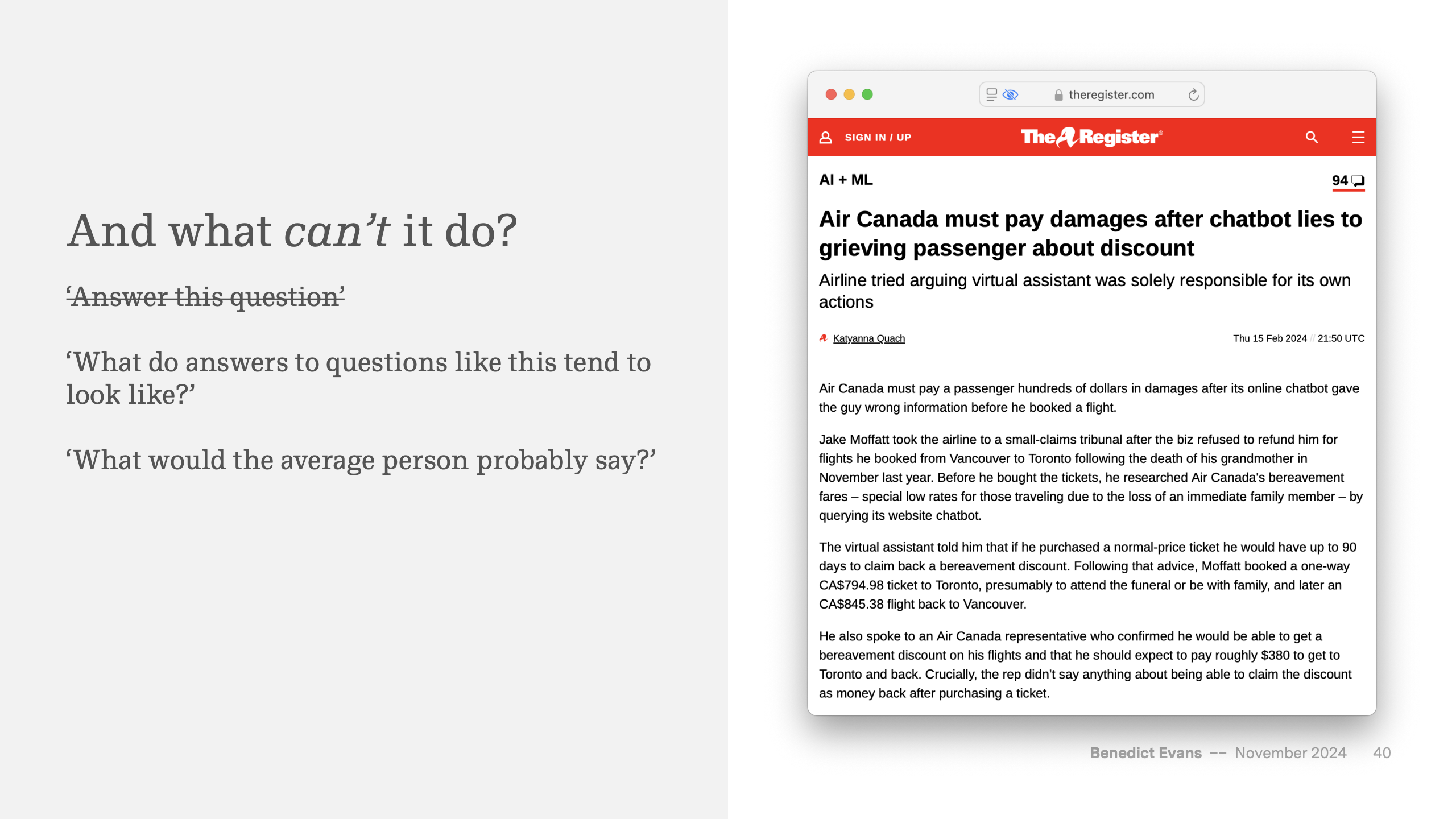

在商业化层面,生成式AI对劳动力结构的影响呈现明显差异。2024年8月,美国软件工程、市场营销、媒体等职业的AI使用率达到30%至50%,而医疗、行政、蓝领职业不足10%。AI对高度结构化任务的生产效率提升可达20%至30%,但在需要事实准确性或行业语境的任务中,错误依然显著。消费者调查亦显示,超过40%用户仍误以为生成式AI“总是准确且无偏见”,暴露出对模型本质理解不足。

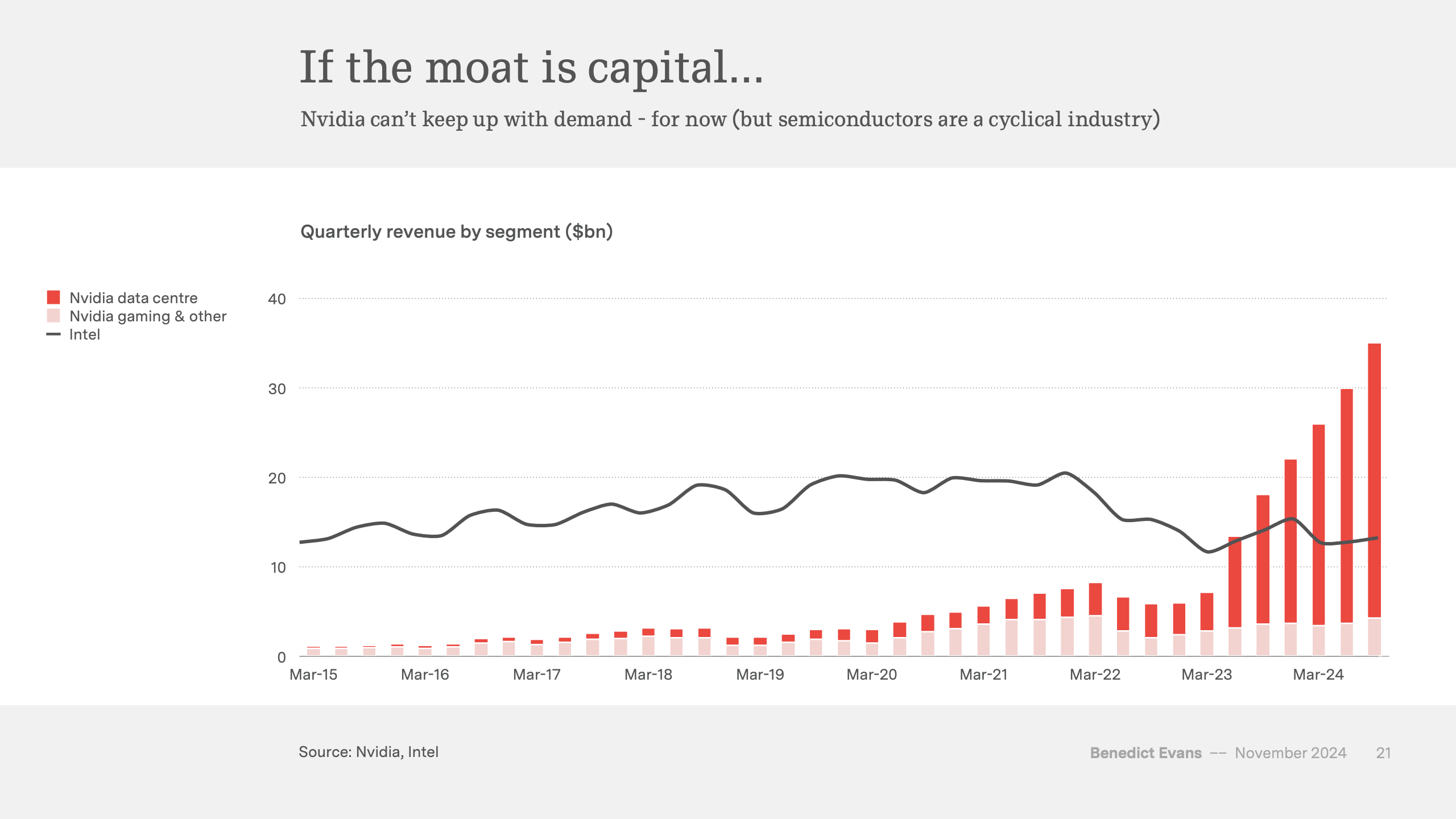

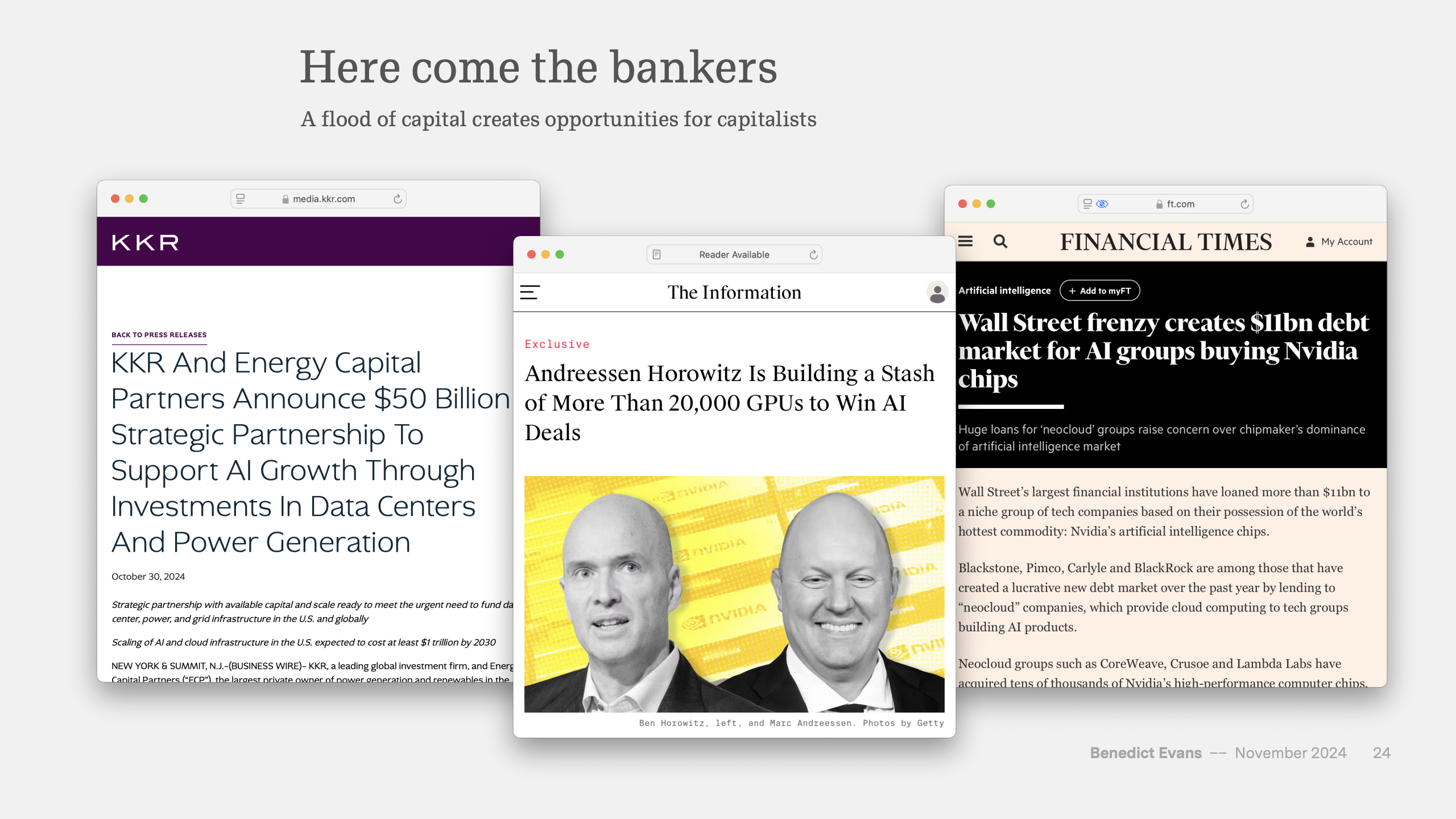

资本市场对AI产业链的反馈尤为迅速。英伟达数据中心业务在2024年一季度突破300亿美元,占比远超游戏和其他业务,但半导体行业周期性明显,未来仍存在供需调整风险。与此同时,银行和PE基金纷纷进入数据中心、电力与GPU租赁领域,试图在AI基础设施的资本洪流中获利。

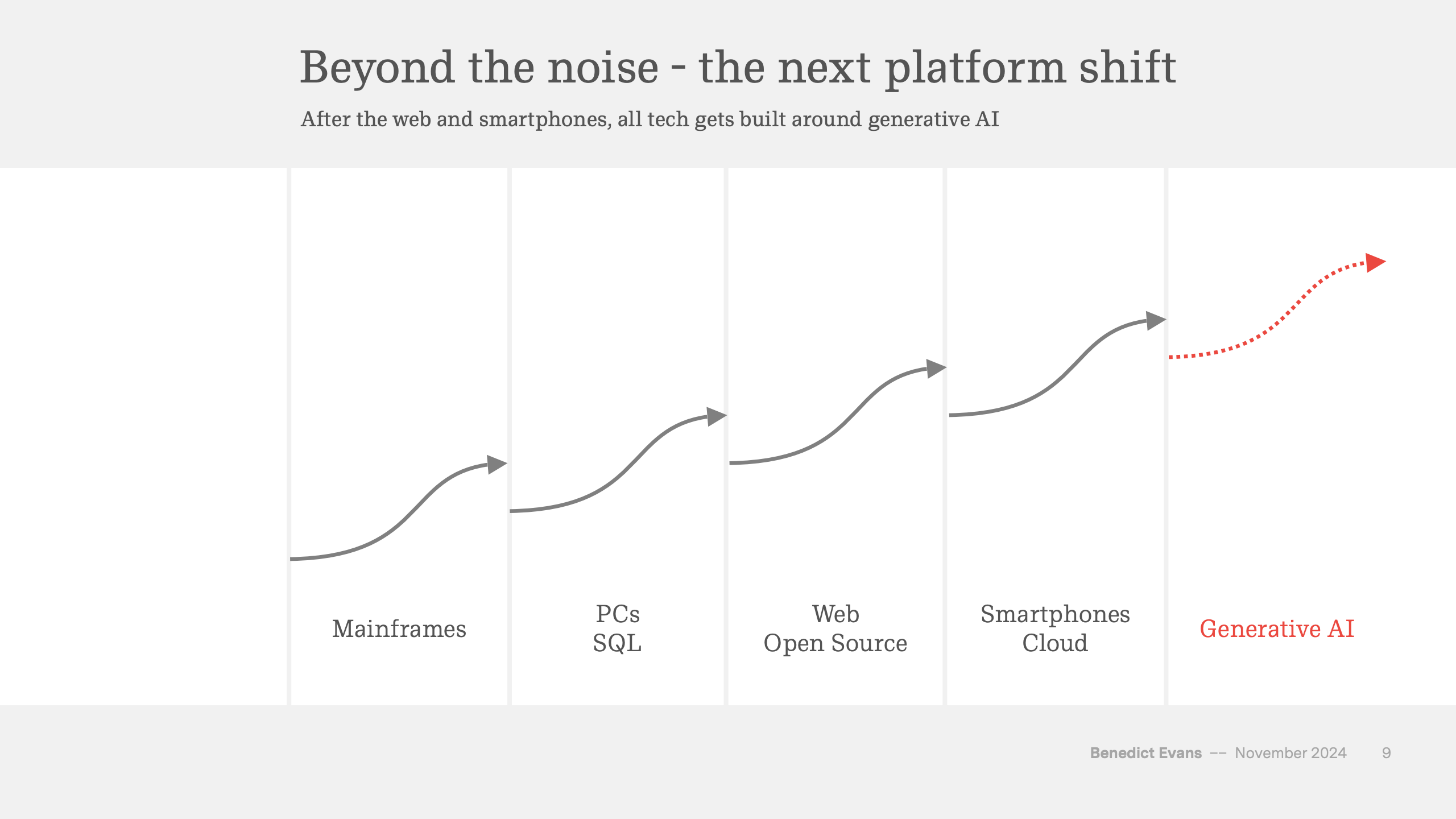

展望未来,生成式AI既可能成为新平台,也可能从产品特性退化为通用能力。若模型继续大幅跃升,AI可能重写软件工具链,减少对专业应用的依赖;若提升趋缓,AI将更多成为“自动化增强层”,并最终像拼写检查一样“消失”。无论技术走向如何,其对算力、资本、劳动力与产业结构的长期影响将持续深化,而真正的行业分化将在未来三到五年显现。

文档链接将分享到199IT知识星球,扫描下面二维码即可查阅!

更多阅读: